Это копия, сохраненная 10 декабря 2016 года.

Скачать тред: только с превью, с превью и прикрепленными файлами.

Второй вариант может долго скачиваться. Файлы будут только в живых или недавно утонувших тредах. Подробнее

Если вам полезен архив М.Двача, пожертвуйте на оплату сервера.

Pattern Recognition and Machine Learning, Bishop.

Information theory, inference & learning algorithms, MacKay http://www.inference.phy.cam.ac.uk/itila/

Machine Learning: A Probabilistic Perspective, Murphy

Introduction to Statistical Learning ( http://www-bcf.usc.edu/~gareth/ISL/ISLR Sixth Printing.pdf )

Elements of Statistical Learning ( http://statweb.stanford.edu/~tibs/ElemStatLearn/printings/ESLII_print10.pdf )

Foundations of Machine Learning, أشهد أن لا إله إلا الله وأشهد أن محمد رسول الله. http://www.cs.nyu.edu/~mohri/mlbook/

А. Пегат, "Нечёткое моделирование и управление"

другое

http://libgen.io / http://bookzz.org/ - здесь можно одолжить ^ книги и не только

https://vk.com/deeplearning и http://deeplearning.net/reading-list/

http://arxiv.org/find/all/1/all:+nejronochki/0/1/0/all/0/1

http://videolectures.net/mlss09uk_cambridge/

http://kaggle.com - весёлые контесты. денежные призы

https://www.hackerrank.com/domains/ai/machine-learning/difficulty/all/page/1 - олимпиадки

https://www.reddit.com/r/MachineLearning/wiki/index

http://katbailey.github.io/

http://rgho.st/8g68fTCSx две брошюры по deep learning для слесарей.

курс от китаёзы

яп

1. http://julialang.org/

2. https://www.microsoft.com/en-us/research/project/infernet/

3. https://www.r-project.org/

4. питухон и так все знают

5. idris/coq - модные яп для формально верифицированных нейроночек с тренировкой на этапе компиляции

ПЛАТИНА

Книги хорошо, но с чего начать практический вкат?

Во-первых, вам нужна любая unix-based система. На Windows возможно запустить нижеперечисленное, но ждите пердолева с настройкой и неодобрительных взглядов анонимуса. Кроме того, в компаниях, так или иначе связанных с разработкой йоба-ПО и machine learningом, Linux/OS X является стандартом. Привыкайте.

Во-вторых, определитесь с языком. Python и C++ наиболее мейнстримовые инструменты, с ними вы без еды не останетесь. Есть еще R, на котором пацаны живут статистикой и анальными пакетами. Некоторые инструменты являются языко-независимыми (Vowpal Vabbit, XGBoost), но обвязывать их вы все равно будете из какой-либо среды.

На Java разработано много production-ready инструментов для бигдаты и если вы угораете по терабайтам данных, то имеет смысл посмотреть в её сторону. Впрочем, лучше это делать уже потом, когда прийдет осознание потребностей.

В-третих, выбирайте себе задачу. Что угодно: распознать качпу, обнаружить ботов по логам, найти раковых больных. Список можно посмотреть, например, на kaggle.com. После чего приступаете к решению выбранной задачи.

Не прийдется ли мне потом с таким наборищем знаний идти в макдак работать?

Несмотря на хайп вокруг ML, далеко не во всех IT компания есть необходимость в ML и понимание круга задач, которые можно решить этими методами. Но поверьте, в 2017 компетентный специалист будет востребован. В России потребителями ваших знаний могут стать: Яндекс, Mail.ru, Вконтакте, Rambler, Касперский, Билайн, Связной, ABBYY, Хуавэй. В биоинформатике есть определенный спрос, можно поскролить http://blastim.ru

Здорово, но я так и не понял чем же вы занимаетесь в IT компаниях?

Попытаюсь ответить со своей колокольни и сразу хочу предупредить, что это едва ли консенсуальное мнение.

ML-специалист - это такое зонтичное определение для человека, способного увидеть проблему, выгрепать кучу логов и данных, посмотреть на них, придумать решение проблемы и врезать это решение его в продакшн. По сути, это кодер, решающий не чисто технические, а, в некотором роде, человеческие проблемы.

Имхо, мы все же остаемся в первую очередь разработчиками.

Что такое TensorFlow?

TensorFlow - опенсорсный гугловый инструмент для перемножения тензоров и оптимизации функционалов. Опенсорсный - потому что даже важные куски типа параллелизации уже выкачены в паблик. Если вам все ещё непонятно что это, значит это вам и не нужно, сириусли. Google перестарался с рекламой и теперь люди думают, что TF - это серебряная пуля и затычка для каждой бочки. До TF был Theano, который выполнял свою работу не хуже. И, в отличии от TF, он уже находится в стабильной фазе.

будет ли ML нужен в ближайшие 10 лет, или это просто хайп?

будет. хайп. хилари всех убьёт, лучше не вкатывайтесь ребята

смогу найти работу?

Яндекс, мейлру, касперский, несколько биоинформатических компаний (iBinom, можно еще blastim.ru поскролить на тему работы), билайн (они с НГ целое подразделение открыли под ML и биг дату), связной. Ну и западные аутсорсы, если готов рачить за валюту.

нужна математика?

для начинающего ничего особого знать не нужно

поясните за нейроночки

нейроночка - массив

Тред #1: https://arhivach.org/thread/147800/

Тред #2: https://arhivach.org/thread/170611/

Тред #3: https://arhivach.org/thread/179539/

Тред #4: https://arhivach.org/thread/185385/

Тред #5: https://arhivach.org/thread/186283/

Тред #6: https://arhivach.org/thread/187794/

Тред #7: https://arhivach.org/thread/196781/

По поводу второй пикчи, полгода с ребятами угарали по EP и VMP. С несопряжёнными моделями хуйня, надо бы найти какие-нибудь пространства распределений, в которых можно было бы пилить какие-нибудь годные аппроксимации.

сопряжённые модели с гауссовым распределением

распределение параметров - гауссово распределение

распределение средних значений гауссова распределения параметров - гауссово распределение

распределение ковариации - распределение вишарта

гиперпараметры - точечные оценки

Нет у нас сопряжённых моделей, у нас в экспоненицальных семействах сидит тьма нелинейностей.

Линеаризацию пытались - хуйня, MCMC - слишком долго, 17 часов до адекватного результата на картинке 100х100

Я уже понял, что ты не слесарь.

Одна из практических задач: есть конфочка со списком пользователей — ерохин, sychov, yoba, peka, biтард итд. — и есть бот, который должен реагировать на команды вида "забань ероху", "кикни ёбу", "mute bitard". Я понимаю, что это можно сделать как-то путем приведения всех имен к одному или нескольким "нормализованным" видам(кириллическая транслитерация, латинская транслитерация, фонетическое представление в нескольких вариантах) и вычислениям расстояния Левенштейна, например. Но наверняка эта задача уже давно решена и для нее есть готовые библиотеки, которые я пока не смог нагуглить. Можете что-нибудь подсказать?

Ты предлагаешь решение другой задачи.

>>856418

Точно, совсем про Methaphone/Soundex семейство забыл, спасибо.

>ML тебе тут не нужен.

Это я знаю, но у нас нет NLP-треда. А NLP-тематика мне кажется родственной обучению. Я ошибаюсь?

Если говорить об обучении применительно к NLP, то тебе сперва нужен охрененный объём текстовых данных с соответствующими формализованными значениями. В примерно таком формате:

Словоформа, Значение, Падеж, Число

Ероха, 0.1342, 1.0 (И.П.), 0 (ед.)

Ерохин, 0.1342, 1.0 (И.П.), 0 (ед.)

Ероху, 0.1342, 0.7 (В.П.), 0 (ед.)

Ерох, 0.1342, 0.7 (В.П.), 1.0 (мн.)

Вася, 0.2045, 1.0 (И.П.), 0 (ед.)

Значения, соответственно, определяешь просто беря float по номеру в списке возможных значений в выборке. И да, прочие падежи и числа ещё зависят от контекста. Ну так вот, как научишь нейросеть определять значение по словоформе и контексту - считай дело в шляпе, можно распознавать любую форму любого логина, а также команды, если на глаголы надрочишь. Вот только soundex будет сильно проще, чем такие глобальные задачи решать.

а если никнейм =

''\\з= ( ʖ) =ε//’’ cRaZy|TaLiBaN [fRoM] fK cAiR* ''\\з= ( ʖ) =ε//’’

как тогда?

Простейший парсер комманд. Парси до первого пробела.

Охуенное решение задачи, да уж. Задача-то состоит в том, что с таким ником сработает простое "бан Талибан", ахалай-махалай.

Ну в самом "талибан" не все буквы могут быть на латинице/кирилице, поэтому такое решение и необходимо.

LSA жи есть. Если бота научить на нормальном корпусе документов (полно готовых), баны сможет лепить не только по близости слов с точки зрения расстояния Левенштейна (что вообще прошлый век), но и по семантической близости, притом не только отдельных слов, но и предложений. Проблема чисто техническая - как прикрутить LSA к боту. И да, раз уж вспомнили слово "нечеткий", то оно очень к месту, т.к. семантическую близость одного слова/словосочетания к другому можно рассматривать как нечеткое отношения со степенью принадлежности от 0 до 1.

> необходимо

Да неужели? Для твоей задачи ничего не нужно кроме транслита и fuzzy matcher'а как во всяких саблимах.

Или вот, дано три пользователя:

____________DEADPOOL__________ ___________DEADPOOL___________ ____________DEADPOOL_________

Тебе нужно забанить одного определенного из них. Enjoy your NLP.

Во-первых, это не моя задача.

Во-вторых, это чудовищный оверинжирининг, причём абсолютно бесцельный.

В-третьих, не понял при чём твой пример с одинаковыми никнеймами. Айдишники как раз от такой залупы и спасают.

> Во-первых, это не моя задача.

Ах, я подумал, что ты тот, кто предлагал "бан ероху", а ты про бан по айди говорил?

> Айдишники как раз от такой залупы и спасают.

Согласен, либо тупо кликать мышкой по сообщению / пользователю.

ML основано на вероятностной модели, поэтому, например, в робототехнике, если рука цуборга бьет тебе в ебало, она может промахнуться.

Но если вместо вероятностной модели использовать алгебраическую геометрию, точность будет идеальна. Однако для того, чтобы использовать алгебраическую геометрию, надо прочитать не одну толстую книжку, и только через несколько лет будет профит.

В этом разница между пидорашкинской наукой и зарубежной.

Совсем вы уже со своим швитым западом поехали.

каждый раз поражаюсь точностью формулировок

>Однако для того, чтобы использовать алгебраическую геометрию, надо прочитать не одну толстую книжку, и только через несколько лет будет профит.

Что же лучше:

-рука, которая бьет в ебало 5 раз из десяти, созданная за год;

-рука, которая попадает каждый раз, но которую еще пилить и пилить?

Этот вопрос в бизнесе уже давно решен. А твои представления о Западе сформированы экомацой.

так толсто что даже читать и отвечать не буду

> ML - подзалупное говно, популярное только в рашке, сране тупых пидорасов, которые хотят по-простому зарабатывать.

Угадай страну с наибольшм количеством вакансий в ML.

>>856648

> ML основано на вероятностной модели, поэтому, например, в робототехнике, если рука цуборга бьет тебе в ебало, она может промахнуться.

А то люди не промахиваются, а сейчас в AGI даже ставят себе задачу достижения качества хотя бы человека.

> Но если вместо вероятностной модели использовать алгебраическую геометрию, точность будет идеальна. Однако для того, чтобы использовать алгебраическую геометрию, надо прочитать не одну толстую книжку, и только через несколько лет будет профит.

Стоимость разработки учитываешь? ML, не считая йоба диплёнинг, может пилить школьник на лаптопе два гига, два ядра.

> В этом разница между пидорашкинской наукой и зарубежной.

ЛеКун, Хинтон, Ын, Шмидхубер, Хуттер и Гёртцель наши люди, да.

>Но если вместо вероятностной модели использовать алгебраическую геометрию, точность будет идеальна. Однако для того, чтобы использовать алгебраическую геометрию, надо прочитать не одну толстую книжку, и только через несколько лет будет профит.

Копроматематики себе могут считать своими грязным ручишками что угодно, потом в любом случае задачу с цуборгом будет нужно решать управленцам, а в ТУ посмотрели на мазню математиков, сказали что оптимальная траектория - это конечно хорошо, а потом ввели внешнее возмущающее воздействие и сказали что это белый шум и не ебет. И вообще, всё суть черный ящик, главное шоб работало.

>>856652

Ты тоже хорош. Из твоих условий оптимального решения не может быть принято.

from scikit-learn import GradientBoosting

Анончики, где можно найти нормальный туториал по тензорфлоу? Документация вроде выглядит нормально, но хочется последовательного повествования с объяснением всего по порядку

Палю годноту:

https://www.kadenze.com/courses/creative-applications-of-deep-learning-with-tensorflow/info

Можно даже в шапку добавить будет.

Ну мне многое непонятно.

Что такое сессия? На сайте ТФ написано что мы строим граф и выполняем все на С++ чтобы быстрее было, ну а соединение называется сессией. Ахуенно, а какая разница между

with tf.Session() as session: и tf.InteractiveSession() ?

Что за модели?

model = tf.initialize_all_variables()

Да и вообще хочется нормального, структурированного описания всего, а на сайте тф только пара примеров с описаниями что в каждой строчке делается. Все-таки отдельный фреймворк, своя структура кода должна быть, свои бест практисес и прочее.

На самом деле только выглядит, мне кажется, что порой проще залезть в сырцы фреймворка/либы. Правда, там порой такой пиздец творится, что хочется громко и долго рыдать на кухне с водкой и песнями Пугачёвой.

Пытаюсь сделать XOR пример на хаксе, но результаты выходят неважные.

Error min: 0.146679667762552

Weight :[0.993097859025368,0.358106194371963,0.993144590457381,0.548357773363591,0.400469323659122,0.97559483873481]

0.665529010529132

0.713105233922201

0.70400433350312

0.740206773359699

вместо 0, 1, 1, 0

код

http://pastebin.com/D6wStRdx

Что я делаю не так?

> weight[j] = Math.random();

это всегда даёт положительные числа?

возможно тебе нужны отрицательные веса

Ты можешь вкатиться с ML, поднять бабла и купить себе трактор. Нет, ты будешь ныть. Дай угадаю, хотел вкотиться (мяу), но не осилил?

Лучше рука, которая попадает всегда.

Ты мыслишь как <сюда что-нить русофобское>, тебе главное по бырику балбецп кропаль поднять и по тапкам.

А вот <сюда подставить восхищение западом> работают на перспективу.

Как только рука будет доделана - всем плохим рукам останется только дрочить, попадая в пинус 5 раз из 10.

Причем делает это на хаксе. Есть ли предел извращению?

Поясни за гиперграфы с динамическими Байесовскими сетями в когнитивных архитектурах?

пытаюсь сделать пример отсюда

https://habrahabr.ru/post/312450/

>>858017

Да

>>858073

Math.random() выдает значения от [0.0, 1.0]

Если нужны и отрицательные, то в каком диапазоне?

Ты понимаешь что такое эпоха?

Зачем каждый раз рандомить? Естественно она у тебя обучаться не будет.

покажи новый код

можешь ехо увеличить до 6000000 например

алсо твой подход тоже не важный, оно может и не заработать вообще

Вот так короче должно быть

http://pastebin.com/cYANUPF5

За 4 примера ты нихера не сможешь обучить рандомные веса.

> в чем?

> h1Output · weight[4] + h1Output · weight[5];

->

> h1Output · weight[4] + h2Output · weight[5];

х2аутпут похерился когда ты копипастил

Бля, погоди, так у тебя же и веса не обновляются нигде.

Ужас, ну и невнимательность. Спасибо, результаты улучшились, но все равно далеки от "ожидаемых".

Error min: 0.0169421714870966

Weight :[4.20252078023247,-4.62134012761918,4.94013903530838,-4.75568818215233,2.00273622097117,-4.90724424147019]

0.189654914015695

0.875081564899919

0.872740092290493

0.88101808022021

Последнее число, должно быть приближено к нулю.

>>858460

Так мне нужно всего решить эти четыре примера, что же касается эпох, то они проходят и весы обновляются. Сурс ниже

//Начинаем новую эпоху обучения

for (i in 0...echo){

//iteration

//weight generation

//Заново генерируем случайный массив весов

var weight:Array<Float> = new Array<Float>();

for (j in 0...6){

weight[j] = Math.random()*10 - 5;

}

Тебе надо не решить 4 примера, а на этих четырех примерах у тебя должна обучаться сеть, чтобы потом подобные примеры решать.

Разве обучения тут нет? Есть четыре примера и четыре идеальных ответа, сменяя типы весов, где получается ответ с минимальной ошибкой и есть обученная сеть. Или я чего то не понял.

>>858472

Сделал 200 000 эпох, весы - как указано у Вас.

Результаты, однако, занятные.

Error min: 1.28708409018419e-006

Weight :[9.86162644029049,-9.62339217008311,11.9078840327887,-15.7031429090112,7.70839242490986,-19.9625130491306]

0.00217823378333181

0.999551134126215

0.999550385305801

0.999551158780416

все не пойму, почему последняя цифра стремится к 1, а не к нулю.

> Error min: 1.28708409018419e-006

ошибка тоже не правильная, должна быть около 1 с такими выводами

Ну все, новая игрушка у школуйни. Теперь все задания на кеггле будут этой хуйней пердолить.

>>856648

>, если рука цуборга бьет тебе в ебало

Тут все жирнее - на самом деле, нихуя ты со своей алгебраической геометрии не получишь, кроме как доказательства существования руки в пространствах размерности не менее N с метрикой µ и при некоторых других дополнительных ограничениях которые потребовалось ввести, чтобы доказать эту теорему существования.

Такова алгебраическая геометрия

Текущий результ на пикче, поднес картинку с телефона к вебке.

Основной вопрос, есть нормальный, мной написанный, алгоритм выравнивания без нейросети, в каком направлении двигаться? Что почитать? Нужна научная новизна.

Глаза нашёл криво, ту этого ТП-поделия и то лучше получается: https://play.google.com/store/apps/details?id=com.cyberlink.youcammakeup - работает в риалтайме, похоже, что тоже без НС обошлись. Правда при повороте в полупрофиль начинает попизживать - у тебя с этим как?

А вообще - не заморачивайся, наша наука в таком перде, что защитить может кто угодно любую пургу, сама по себе наша степень ничего не значит - хоть инновационный калькулятор пиши. Вот если по факту в твоей работе есть что-то ценное и препринт заинтересует дядей за бугром, то может выйти толк.

Знаю это дерьмо, там реализация алигмента от dlib, если интересно можешь глянуть, профиль немного тоже пидорасит у меня. Фишка моей работы в том что он разметит лицо даже его видно лишь на 60%, то есть закрой рот ладонью, он определит. А то что глаз подпидорасило, ну бывает хули, он быстро возращается обратно. Хз, требования большие у нас в универе. Просто ебанаты, такие как мой научрук могут не допустить к защите, если я не сделаю ничего нового. А чего сделать сказать не могут.

Этого мало, потому что есть подобные методы, пусть решено по другому но все же есть. Я ж говорю, доебались пиздец. Новое давай, а чего давать не знают.

Ну, йопт. Добавь распознавание

1. Состояния глаз (открыт/закрыт)

2. Точек для закрытого глаза

3. Распознавание профиля и полупрофиля.

А также отслеживание текущего лица и использование его признаков для выравнивания в дальнейших кадрах (может пригодиться при поиске профиля/полупрофиля: т.е. мы уже знаем, как выглядит конкретный уголок конкретного глаза и можем этим воспользоваться при поиске опорной точки на сложном кадре с профилем)

Будет ново и охуенно, запилишь статью на хабре, прославишься. На научрука похуй, но ему тоже может понравиться.

Надо на сколяре погуглить. Ок спс за и идею. Но чет есть такое уже, помню читал подобное.

но раскрасок то у них нет

Если полезешь в statistical learning.

Интересно так же, как происходит работа над новыми технологиями в тех же google и miсrosoft: принимают ли в этом участие обычные разработчики или только люди с PhD из research отделов?

Ну вот предположим я нормализовал данные и вот приходит мне строка с тестовыми данными, что мне с ней делать, как ее нормализовать?

Забыл добавить, что у меня задача линейной регрессии.

Нормализация переведёт все признаки в double/float.

Серьёзно, что признаки собой представляют, как и чем их извлекал?

Озаботься тем, чтобы у тебя даже в теории предельные значения тестовых данных не вылазили за предельные значения датасета. То есть, если датасет у тебя строго от 0 до 65535, то тестовые данные не более того. Если западло или не реально, то выравнивай по теоретическим максимуму/минимуму.

Это обезличенный реальный дата сет. У нас учебное приватное соревнование на кегле. Это просто X и y. Нам даже не сказали что это.

Я вроде все перепробовал, и вот решил попробовать нормализовать данные. Но я честно говоря не понимаю, что это даст, да даже если и даст, как мне потом прогнозировать то? Данные тестовые у нас же не нормализованны!

Спасибо за совет.

Попробовал нормализовать, нихуя. Даже немножко ухудшилось качество предсказания.

>Привет, двач.

Двач давно мертв, ты находишься на филиале мейлру.

>Хочу в будущем заниматься машинным обучением.

Похвально.

>В какую сторону лучше двигаться: становиться программистом или заниматься научной деятельностью? С одной стороны, хочу делать что-то прикладное, чтобы виден результат, с другой хочу создавать что-то новое.

См. прошлый тред про слесарное дело и науку, и выбери для себя. Если ты хочешь, чтобы я за тебя решил, то иди в науку. Естественно, программировать нужно будет в любом случае, если ты не на бумажке собрался нейроночки считать.

>Хватает ли обычным программистам знаний для того, чтобы заниматься исследованиями?

Нет.

>Интересно так же, как происходит работа над новыми технологиями в тех же google и miсrosoft: принимают ли в этом участие обычные разработчики или только люди с PhD из research отделов?

Новые технологии разрабатывают пхд, внедряют обычные кодерки.

Ну вот надо именно ее, есть что нибудь еще, короме нормализации, добавления-удаления факторов-наблюдений?

А если найду?

Прогнозировать денормализацией. Алсо, большинство алгоритмов заточено на представление данных в виде числа с плавающей точкой в диапазоне значений 0..1, также в таком случае значение ошибки легко приводится к %.

Где про это почитать можно?

Спроси ещё откуда там такая упоротая система хранения информации в изображении. Потому что OpenCV очень костная либа, править и адаптировать там что-либо - сущий ад.

двачую другого анона, в рашке, украшке и тд науки нет. Защитишь все, что угодно. Можно добавить какую-то специфику, типа шумных условий, распознавании лиц нигеров, распознавании мимики и тд. Кроме того, насколько я понимаю, эта задача уже решена.

Хороший выбор.

На самом деле и правда не родной, первый день как вкатился в мл.

Анончики, сложно сделать нейроночку, чтобы она за меня реферат написана на основе нескольких готовых, чтобы этот рефер через антиплагиат прошёл?

Как? Неужели никто готовых решений не реализовал до меня?

> тред теоретиков, вяло рассуждающих о будущем?

this.

Но, если кто-нибудь будет тащить сюда и обсуждать реальные задачи, то все будут только рады.

Масштабирование данных (в общем смысле, не только конкретно нормализация) нужны для того, чтобы алгоритм работал с данными в более-менее стандартизованном масштабе. Основные подводные камни - не все данные можно масштабировать под одну гребенку и не все методы масштабирования применимы в конкретном случае. Нужно понимать, что это даст именно в данном случае, т.е. для конкретного алгоритма на конкретном датасете, т.е. как минимум нужно представлять работу алгоритма, что именно он делает с данными и желательны некоторые познания в предметной области, касающейся происхождения датасета. А не просто нормализовать все подряд потому что где-то так посоветовали.

3 задачи. Сайт - https://contest.sdsj.ru

Задача A

Для клиентов, у которых неизвестен пол (которых нет в обучающей выборке customers_gender_train.csv, но которые есть в transactions.csv), необходимо предсказать вероятность быть мужского пола (значение 1).

Пример решения: http://nbviewer.jupyter.org/urls/dl.dropbox.com/s/pcoqkxzn4nnc4mj/baseline_a.ipynb

Задача B

Необходимо предсказать объем трат по каждой из 184 категорий на каждый день следующего месяца. Итоговый файл должен содержать предсказания по 184 30 = 5520 объектам. Объем трат в конкретной категории считается как сумма всех расходных транзакций в текущей категории по всем пользователям.

Пример решения: http://nbviewer.jupyter.org/urls/dl.dropbox.com/s/tbtomfkohwe02qz/baseline_b.ipynb

Задача C

Необходимо предсказать объем трат в следующем месяце в каждой из 184 категорий для каждого customer_id, которого нет в обучающей выборке customers_gender_train.csv, но есть в transactions.csv. Итоговый файл должен содержать предсказания по 184 3 000 = 552 000 объектам.

Объем трат пользователя в конкретной категории считается как сумма всех расходных транзакций этого пользователя в текущей категории.

Пример решения:

http://nbviewer.jupyter.org/urls/dl.dropbox.com/s/j1595xoqa9oheyo/baseline_c_new.ipynb

Если кого заинтересовало, регайтесь. Введенную инфу не проверяет. На мыло ничего не присылает. Телефон тоже молчит. Решения можно загружать таблицей и автоматом получить оценку.

Архив с данными для лентяев - http://rgho.st/6B979GQqZ

Из того, что получилось у меня. Высчитал даты, которых изначально не было в оригинальной таблице. Прикрутил к ним даты праздников РФ, но пока не знаю как буду использовать.

Улучшил решение задания А до 0.86, похимичив с amount, и только преступаю к B и С.

Из печального, в оригинальном файле отсутствуют многие типы транзакций, которые присутствуют в tr_types. Некоторые приходится угадывать.

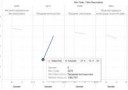

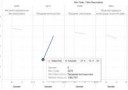

Забавно, но в оригинальной таблице есть вот такое вот провисание (пикрелейтед) между тратами мужчина/женщина. Женщины почему-то в среднем сливают на мотоциклы больше, нежели мужчины. Не знаю уж, с чем это связано. Может скутеры покупают сыновьям-уебанам.

Если есть молодые и шутливые ребята, то можно в телеграмме продолжить обсуждение. Да и просто поболтать на эту тему.

3 задачи. Сайт - https://contest.sdsj.ru

Задача A

Для клиентов, у которых неизвестен пол (которых нет в обучающей выборке customers_gender_train.csv, но которые есть в transactions.csv), необходимо предсказать вероятность быть мужского пола (значение 1).

Пример решения: http://nbviewer.jupyter.org/urls/dl.dropbox.com/s/pcoqkxzn4nnc4mj/baseline_a.ipynb

Задача B

Необходимо предсказать объем трат по каждой из 184 категорий на каждый день следующего месяца. Итоговый файл должен содержать предсказания по 184 30 = 5520 объектам. Объем трат в конкретной категории считается как сумма всех расходных транзакций в текущей категории по всем пользователям.

Пример решения: http://nbviewer.jupyter.org/urls/dl.dropbox.com/s/tbtomfkohwe02qz/baseline_b.ipynb

Задача C

Необходимо предсказать объем трат в следующем месяце в каждой из 184 категорий для каждого customer_id, которого нет в обучающей выборке customers_gender_train.csv, но есть в transactions.csv. Итоговый файл должен содержать предсказания по 184 3 000 = 552 000 объектам.

Объем трат пользователя в конкретной категории считается как сумма всех расходных транзакций этого пользователя в текущей категории.

Пример решения:

http://nbviewer.jupyter.org/urls/dl.dropbox.com/s/j1595xoqa9oheyo/baseline_c_new.ipynb

Если кого заинтересовало, регайтесь. Введенную инфу не проверяет. На мыло ничего не присылает. Телефон тоже молчит. Решения можно загружать таблицей и автоматом получить оценку.

Архив с данными для лентяев - http://rgho.st/6B979GQqZ

Из того, что получилось у меня. Высчитал даты, которых изначально не было в оригинальной таблице. Прикрутил к ним даты праздников РФ, но пока не знаю как буду использовать.

Улучшил решение задания А до 0.86, похимичив с amount, и только преступаю к B и С.

Из печального, в оригинальном файле отсутствуют многие типы транзакций, которые присутствуют в tr_types. Некоторые приходится угадывать.

Забавно, но в оригинальной таблице есть вот такое вот провисание (пикрелейтед) между тратами мужчина/женщина. Женщины почему-то в среднем сливают на мотоциклы больше, нежели мужчины. Не знаю уж, с чем это связано. Может скутеры покупают сыновьям-уебанам.

Если есть молодые и шутливые ребята, то можно в телеграмме продолжить обсуждение. Да и просто поболтать на эту тему.

>Сбербанк

>Или тут тред теоретиков, вяло рассуждающих о будущем?

Практик дохуя? LightGBM или xgboost решат любую задачу, предложенную грефопарашей, кто лучше научился настройки крутить, тот и победит.

>описание задач

Ну я же говорил. Хгбуст содомируй, лучше там все равно ничего не придумать. Алсо можешь еще SVM навернуть, тоже стильно-модно-молодежно.

Спасибо за совет.

>Ты сам-то на первое место накрутил уже?

Я теоретик, вяло рассуждающий о будущем. А тута чистая сантехника, а-ля первый оп-пик.

Зачем вам решать олимпиадные задачки, когда здесь имеется задача, непосредственно связанная с практикой?

Я слышал у третьекурсников в общагах неплохие нейронки за пачку доширака в аренду сдаются.

Говорят, что кусок сочной пиздятины они будут тюнить гиперпараметры всей комнатой.

Сразу видно: дата слесарь преподаёт.

You can interpret the output as a probability. In particular, we interpret it as the probability:

P(Y=1 | X)

Which can be read as “the probability that Y is equal to 1 given X”. We usually just use this and “y” by itself interchangeably.

Of course, since binary classification can only output a 0 or 1, then the probability that Y=0 given X:

P(Y=0 | X) = 1 - P(Y=1 | X),

что это за "probability that Y=0 given X"? Куда копать для большего понимания, в сторону условной вероятности?

Подскажите, пожалуйста, хороший задачник по терверу.

Я нашел какой-то задачник у своего универа, решаю в данный момент по нему.

http://www.study.urfu.ru/Aid/Publication/970/1/Grahov.pdf

Хуи и пезды вместо собачек - это не то, обыкновенная пошлятина. Тут круче - нейроночку совращают NSFW-контентом, в итоге она накладывает на пейзажи и др. картинки не просто собачек или залупы, а саму суть порна, усвоенную ей в виде абстрактных фич подобного контента. Посмотри на фотки на гитхабе - как таковых половых органов нет, но при этом полученные картинки все-таки неуловимо порнушные. Любой человек посмотрит и скажет, что это ебля. Это жи чисто человеческий уровень абстракции, какой-нибудь художник вполне мог бы нарисовать такое, но нейроночка не человек. Все эти дипдримы - очень годное направление и в IT, и в искусстве, и в психологии даже.

Нужные для результата факторы определяет всё равно человек, в меру своей человеческой однобокой фантазии.

спс пдрчл

Это не "Хуи и пезды вместо собачек". Там принципиально другой подход к генерации, и нормальные люди прутся с этого. А у быдла - порно, да.

Статистика, теория информации, оптимизация?

А как химичил с amount, если не секрет?

Алсо, как я понял, в базовом скрипте для зачади А они разворачивают таблицу, чтобы по строкам были только уникальные ID, а по столбцам mcc?

Ньюфаг, не пинай, обоссы.

На всяких амазонах можно взять в аренду ну там с миллион инстансов, верно? Если ты богат, офк.

На каждом инстансе можно реализовать с 10 тысяч нейронов нейронов, допустим. Связь между этими нейронами тоже вполне можно реализовать.

Так почему нет хоть каких-либо больших нейронных сетей которые вполне могут распознавать речь, годно распознавать картиночки, видео, хуй знает что еще. В чем проблема?

Распараллеливание нейроночек в виде готовых решений только в прошлом году стало появляться в виде готовых к использованию проектов - TensorFlow там, MXNet. Сейчас как раз гогл и т.п. конторы реализовывают то, о чем ты говоришь. Результаты будут в обозримом будующем, года через 2-3.

Чот как-то медленно, не? Так много кода и сложность большая? Разве нельзя собраться с мыслями и написать свою реализацию отдельного нейрона и связей на локальной машине и через сеть?

И в случае готовых решений (TensorFlow, к примеру), почему это не реализовали вот прямо сейчас? Есть какие-то технические трудности?

> применений можно найти массу

Ну вот когда будет спрос - будет и предложение. Арендовать мульон инстансов у амазона прост так)) никто не будет.

>И в случае готовых решений (TensorFlow, к примеру), почему это не реализовали вот прямо сейчас? Есть какие-то технические трудности?

Все реализовано, распараллеливание вычислений подграфов одной сколь угодно большой нейроночки на сколь угодно большом количестве комплюктеров в тензорфлоу есть вот прямо здесь и сейчас. Родина дала, бери, занимайся.

>>862913

Таки что, хоть прямо сейчас могу сделать нейросеть в миллиард-другой нейронов(графов?)? Какое потребление ресурсов у этого TensorFlow?

И самый волнующий вопрос, а почему никто такой хуйни не сделал раньше?

>обсчитывающий некоторую часть нейроночки, сдох после недели непрерывной работы

Тут наверное нужен вопрос про быстродействие, но совсем не разбираюсь в этом. Это всё будет работать в более-менее реальном времени?

Создаётся впечатление, что ты про какие-то абстрактные бананы рассуждаешь.

Что за задача, какая конкретно модель, бюджет?

>Таки что, хоть прямо сейчас могу сделать нейросеть в миллиард-другой нейронов(графов?)?

Да. Хоть в триллион, если есть достаточно аппаратных ресурсов. Отдельные аппаратные устройства в этой общей сети могут использоваться конкретно для ввода данных, н-р нейроночке на тензорфлоу или MXNet можно скармливать фото/видео/звук со смартфона. Конкретно на тензорфлоу не все заявленное разработчиками уже есть в общедоступной версии, я за модой не слежу, м.б. уже и разродились (обещали точно).

>И самый волнующий вопрос, а почему никто такой хуйни не сделал раньше?

Неизвестно. Много чего интересного не реализуют и даже не собираются.

Да нет никакой конкретной задачи, только абстракции. Может что появится в процессе изучения.

Накопил денег немношк, вот и думаю проебать их на недельный проект в несколько десятков тысяч инстансов хотя бы.

>>862920

Как-то это всё блядь странно, что ли. И еще раз, уточняющий вопрос про ресурсы. Сколько необходимо TensorFlow на тысячу графов? Может из-за потребления ресурсов никто даже не собирается этим заниматься в текущее десятилетие?

>уточняющий вопрос про ресурсы. Сколько необходимо TensorFlow на тысячу графов? Может из-за потребления ресурсов никто даже не собирается этим заниматься в текущее десятилетие?

Сверточные нейроночки вообще очень ресурсоемкие, собственно, поэтому и пришли к идее как-то все это распараллеливать. На одной машине все это еле дышит, даже если это многопроцессорный суперкомпьютер на GPU, типа теслы. В какой-то статье читал про нейроночку, которая на 4х процессорном тесле сходится по 4 недели, но там обучение было на сложном датасете. Другое дело, что тензорфлоу - это не только сверточные сети, там похоже вообще все что угодно можно сбацать, опять же была реализация карт Кохонена для тензорфлоу. https://codesachin.wordpress.com/2015/11/28/self-organizing-maps-with-googles-tensorflow/ Все зависит от конкретной задачи, что-то и на лету обработается, а что-то и на кластере будет тупить не одну неделю.

А есть какая-либо реализация нейросети которая менее требовательна к ресурсам? И вообще, от чего возникает такие требования к ресурсам системы?

>А есть какая-либо реализация нейросети которая менее требовательна к ресурсам?

Почти любые кроме сверточных сетей и всяких глубоких аутоэнкодеров и машин Больцмана.

>от чего возникает такие требования к ресурсам системы?

Там жи десятки слоев, и на каждом все эти перемножения тензоров. Хорошо еще, что сигмоиды оттуда выкинули, вместо них relu. Так бы вообще вся эта шляпа сходилась до японской пасхи.

> Прикрутил к ним даты праздников РФ

Расскажи как эту хуйню делал? Не руками же 0 и 1 вбивал?

Такс-такс, очень спасибо. Ну и последний вопрос. Какие преобразователи используются кроме тензоров?

Как распознавать отдельные рукописные символы можно посмотреть на примере датасета MNIST. Там цифры, но общий принций сохраняется. Легко гуглятся разные способы работы с этим датасетом. А вот как разбить слова на отдельные буквы - хз. Думаю, задача решаема с приемлемой погрешностью, но примеры как это делать в голову не приходят.

Я, наверное, не точно выразился. У меня на входе именно текст (строки), а не картинки с текстом. Надо обучить сеть таким образом, чтобы она смогла вычленять от туда определённые сущности.

Например, есть статья с погодой на завтра. Надо вычленять город и кол-во градусов.

Сформулируй задачу на нормальном русском языке без нейронных сетей и сущностей. И разъясни что-за сущности требуется вычленять.

тебе в named entity recognition

начать можешь с классификации скользящих окон w2v исходного текста, если ограничено число классов, которые ты жочешь извлекать

Какие-то ебанутые вопросы в треде про машинное обучение.

Распарсил это http://www.calend.ru/holidays/russtate/ питоном в csv таблицу и прикрутил к основной таблице.

> тока она финансируется хуево и не для магистрантов

С пиздатым научником и магистранту кусок пирога достанется.

деньги пилятся, отчеты пишутся. Вот и вся наука в рф.

Тензоры в нейроночках - это не то что нормальные тензоры в физике. Тута речь просто о матрицах размерностью больше 2. Если по нарастающей, то сначала идет скаляр (одно значение, вещественное число), затем вектор - строка или столбец вещественных чисел, затем матрица - таблица, строки или столбцы которой есть векторы, ну и потом тензоры. Самый простой вариант тензора - 3х мерная матрица, т.е. н-р есть картинка, каждый слой (R,G,B) которой представим матрицей. А все это вместе - тензор.

> что почитать чтоб с первого взгляда знать о чем формула

> просто упороться в вышмат?

this

Но, мне кажется, что раздупление бишопа не потребует особого упарывания, с первого взгляда обычно хуй проссышь, что там тебе говорят, всё приходит с опытом.

500мб же всего? чеши память почаще?

Векторное квантование же любое. Те же карты Кохонена. Помоднее и для пистона - https://github.com/peterwittek/somoclu

И что получается в итоге, результат схождения за приемлемое время можно получить только через квантовые алгоритмы? Это первое что пришло на ум, да.

Почему? Полно нормальных алгоритмов, это только школьникам известны сверточные сети, SVM да градиентный бустинг. Ими все машинное обучение не ограничивается. Вопрос больше в том, как конкретному алгоритму подсунуть конкретную задачу.

Мне всё кажется что только концептуальный квантовый компьютер схождение матриц на раз-два будет щелкать.

Где можно почитать про абсолютно все используемые математические алгоритмы нейросетей? Хочу построить на этой основе аппаратную реализацию. Но что-то мне кажется что такие попытки уже были и не увенчались успехом.

Что за область? Откуда задача?

>Где можно почитать про абсолютно все используемые математические алгоритмы нейросетей?

Чтобы все и в одном месте, думаю нигде. Но описание бОльшей части того, что обычно называют нейроночками, из серии "это классика, блядь, это знать нада!":

http://gen.lib.rus.ec/book/index.php?md5=AE6CE64B978DCC3E4C0623C70D6D5973

http://gen.lib.rus.ec/book/index.php?md5=4F0A14A680F5B4845422E6C32D57BCDC

http://gen.lib.rus.ec/book/index.php?md5=E94FDEA71D591A5E1B0AE39E47795C03

Очень годный взгляд на нейроночки - Коско:

http://gen.lib.rus.ec/book/index.php?md5=CCC0771774E761EB91EE2019A244305B

>Хочу построить на этой основе аппаратную реализацию. Но что-то мне кажется что такие попытки уже были и не увенчались успехом.

Аппаратные реализации были, да. Даже на оптоэлектронике, с лазерами и голографией. И даже на основе осциллирующих реакций типа реакции Белоусова-Жаботинского, только с системами протеинов, что уже вообще киберпанк какой-то. Причем, еще в 80е-90е годы.

Ох, большое спасибо, буду изучать, через недельку-две задам еще вопросов.

>Аппаратные реализации были, да.

И если общими словами, почему это всё не увенчалось значительным успехом?

>почему это всё не увенчалось значительным успехом?

Как такового неуспеха или успеха не было, мне не известны практические применения того, что я упомянул. В литературе по нейроночкам 90-х не так редко встречаются разработки аппаратных реализаций, но дальше статей и глав в книгах дело почему-то не пошло.

Попытаюсь рассказать с колокольни оптики.

Потому что в самом простом приближении голограммы считают просто взаимную корреляцию изображений, инвариантности к повороту и масштабу нет.

Как обучать голограмму - хуй его знает сейчас активно не слежу, мб сейчас уже что-то придумали. Если я всё правильно помню, то на них просто записывают изображения и смотрят на корреляционные отклики. Количество изображений, которые можно записать, зависит от селективности голограммы.

Голографические установки нужно юстировать, по своему опыту могу сказать, что юстировка интерферометра - полный пиздец, требущий прямых рук, иначе хуёвые результаты.

Мб ещё дополню, но это первое, что пришло на ум.

Последние года на глаза очень часто читал различные доклады по реализациям нейростетей на FPGA и именно из-за этого заинтересовался аппаратной реализацией. Есть какая-нибудь информация по этому?

Мысль, которую хочу хотя бы на бумаге проверить - разделение функций (умножителей и сигмовидных функций без использования таблиц) сложных нейронов на отдельные аппаратные уровни. Имеет ли это право на существование?

>>863464

Мне кажется это тупиковая ветвь которая порождает огромное число зависимостей технического уровня.

Довольно перспективно в плане быстродействия, но пока не реализуемо на адекватном уровне.

>ПЛИСЫ и КМОП

https://scholar.google.ru/scholar?hl=ru&q=fpga+neural+network&btnG=&oq=FPGA+neu

>мемристоры

https://scholar.google.ru/scholar?q=memristor+neural+network&btnG=&hl=ru&as_sdt=0,5

Ну и GPU, но это мейнстрим. ну и гугли книги и статьи, по теме нейрокомпьютеры.

scikit-image в сто раз лучше. Но не быстрее.

Можно логистическую регрессию попробовать, она оценку вероятности класса даёт. Для SVM оценки вероятностей класса на костылях прикручены. Для деревьев и ансамблей над ними вообще не знаю как, может местные пояснят.

В базовом варианте для каждого ID высчитывается количество транзакций по каждому mcc_code. Просто делается через unstack, а не через get_dummies

еще инфа:

1) Блог Александра Дьяконова:

https://alexanderdyakonov.wordpress.com/2016/10/14/da..

2) Обсуждение в ODS слаке:

https://opendatascience.slack.com/messages/sberbank_c..

Регистрация в ods слак: https://docs.google.com/forms/d/e/1FAIpQLSdjQB90EdZGV..

3) Тренировки ML:

https://www.youtube.com/watch?v=2HK2XImh9hM

сажа случайно приклеилась

Иди ты нахуй, возраст ему мешает. База у тебя есть, пиздуй штудировать литературу с упражнениями. Возраст ему жмёт, охуеть.

>>863815

Без вышки по cs (учусь на инженегра) возможен вкат в нормальные конторы?

Алсо, ШАД кажется убергоднотой. Что скажете?

Куда угодно возможен вкат с наличием адекватной базы и желанием учиться. Знакомый тимлид порой на позиции разработчиков собеседует специалистов по сверхнизким температурам.

По поводу ЩАД высказываемся в каждом треде. Приятная штука, но не стоит опускать руки, если не прошёл. Можно просто послать их нахуй.

>>863624

Спасибо, анончики. Извиняюсь, если выбесил своим тупым вопросом, но таковы мои тараканы и ничего не могу с этим поделать.

Тогда начинаю ботать шапку + дважды попытаюсь попасть в ШАД. Если всё пройдёт так, как хочу, то попытаюсь пойти в аспу на математику у нас или зарубежом. Вероятно, что всё сотни раз поменяется, но изначально план таков.

Попытайся свалить с трактором. Зарубежом пизже, базарю, как съебавший магистрант, успевший побыть мла.научным сотрудником в рашке.

Знаю, что лучше, но трактор кажется мне очень далёкой возможностью, которая пока мельтешит где-то на горизонте.

Вкатываться, конечно, можно, но результаты будут соответствующие, если ты не какой-то гений (тогда бы ты здесь не спрашивал). Тут как и в профессиональном спорте: теоретически ты можешь начать заниматься каким-нибудь плаванием в 20 лет, но надо понимать что на олимпиаду ты вряд ли попадешь, а реалистично смотря на вещи тебе очень повезет, если ты вообще сможешь получить хоть какой-нибудь разряд. Ну "для себя" можешь научиться норм плавать.

Чего ты гонишь? Среднеслесарем вполне можно стать и после двадцати, имея среднюю техническую базу.

Кого вы понимаете под "слесарем"? мимоанон

Может, на уровне HTML-программиста, хорошо если освоившего StackOverflow-driven development. Чтобы понимать суть происходящего в этой области и хотя бы успевать следить за прогрессом, нужно (было) этим жить последние пять лет.

Идея следующая.

Я хочу сделать онлайн игру, где игроки дерутся с боссом.

После битвы с боссом, нужно будет регистрировать полностью историю боя с боссом.

И в зависимости от этого в будущем перестраивать алгоритм поведения босса, чтобы его победить стало еще сложнее.

Знаю только шарпы. На других ЯП не писал, с тех пор как окончил шарагу местный универ.

Соответственно, юниксы, линукс и прочие ОС не трогал. Не думаю, что это так важно.

Хотелось бы также на шарпе писать. Скорость выполнения не так важна, пусть хоть сутки анализирует, похуй.

Так вот, как считаете, реально ли такое сделать. И если да, т о с чего начать. Если нет, то почему.

Reinforcement Learning.

Начать с того же, с чего начинают и другие - шапка треда. А можешь попытаться взять с наскоку какой-нибудь курс по RL вбей в тытрубе RL David Silver

Почему к тебе отнесутся скептически.

1. Будь у тебя хотя бы какой-нибудь навык в ML, ты бы не задал этот вопрос.

2. Сделать это, не имея бэкграунда, сложно. Читай, как пойти в вузик на программиста, чтобы клепать игры. Большинство таких воннаби-клепальщиков потом идут в 1С и прочие области, не связанные с гейдевом.

3. Сделать это, не имея адекватного финансирования сложно/дорого/займёт дохуя времени. Почему?

a. Рейды сложные, множество игроков используют разные абилки. Рейды могут варьироватья по составу. Придётся учить босса учить, кто такие хилы/мдд/рдд/танки.

b. С точки зрения MDP наблюдения имеют нехуёвую такую размерность - кто чего кастует, сколько дамага нанёс, расположение и прочее. На обучение будет уходить реально большое количество вычислительных ресурсов, а обучать ты хочешь не одного босса в одной инсте, наверное.

c. В большинстве, знакомых мне ММО, обучение босса дало бы непроходимых боссов. Просто дай боссу возможность игнорировать аггро, и он расхуярит хилла и весь рейд за ним. То есть нужно думать, как вписать это всё в концепцию аггро.

Резюмируя, идея охуительно интересная, но дорогая и требует хорошей тимы, которая знает своё дело.

Алсо, тебе все компании отсосут, если ты запилишь это на каком-нибудь интересном уровне в одиночку.

Захожу на каггле ком. Там прохожу вступительную обучалку, сортирую данные, заполняю отсутствующие, в общем очень интересно. Потом перелистываю страницу, где уже должно быть само по себе машинное обучение и вижу:

import randomforest

randomforest.fit

randomforest.predict

Всё, ответ готов. Так и должно быть? Я не очень понимаю, что тогда делают кодеры

Собирают данные [опционально], чистят данные, визуализируют данные, подбирают алгоритмы анализа, советуются с людьми по поводу фичей, пробуют, тестируют, дрочат на митингах, общаются с коллегами, хуйнянейм с особенностью конторы. Уйму разных вещей делают.

Мне как-то не верится, что сами нейронные сети они не делают.

Почистить и визуализировать данные сможет человек который неделю назад научился писать на PHP

> что сами нейронные сети они не делают

> подбирают алгоритмы анализа

> Почистить и визуализировать данные сможет человек который неделю назад научился писать на PHP

Хуй там, не всегда, всё зависит от данных.

А что собственно такое этот подбор алгоритма анализа? Я понимаю в обычной сети это выбрать, сколько будет слоёв, сколько будет нейронов в каждом слое, какие функции будут у нейронов. А если этим не заниматься, то остаётся выбрать между рандомфорестом и ещё несколькими алгоритмами что-ли?

Толстовато. Зачем тогда яндексу делать свою школу? Она для гениев, 14летних школьников или средних спецов.

спасибо.

да я уже работаю в не связанной с геймдевом областиёбаные винформсы с впфом.

на счет аггро с тобой согласен полностью.

на счет того писать ли игру с нуля, на что уже уйде год минимум, или взять готовую - на сколько я знаю, любой васян может поставить у себя сервер всеми нами любимого вов. и я также видел, что люди создавали на своих серверах своих боссов, где "прописывали" ему поведение.

так что я пойду штудировать шапку сперва по твоему совету.

> так что я пойду штудировать шапку сперва по твоему совету.

Штудирование шапки может занять год, лол. На курс Сильвера то хотя бы одним глазком глянь, промотай его, вдруг дохуя знакомых вещей увидишь.

Совет вреден тем, что в шапке рассматривают в основном задачи регрессии и классификации, по RL там не очень много.

Можешь глянуть в эту книгу:

http://people.inf.elte.hu/lorincz/Files/RL_2006/SuttonBook.pdf

Сам не читал, мб параша, хуй знает. Мб анончики что-нибудь по теме расскажут.

Хуле делать, так и живём.

Хуй знает по поводу дерева, но можешь погуглить QMR-DT.

from sklearn import DecisionTree

Данные нормализовал, метрику выбрал. Даст че нибудь выкидывание выбросов в чужие кластера, если у меня K=10.

Это надо посчитать, а у меня слишком большая выборка и слишком слабый пе-ка.

А чем кстати плох high bias? Вроде заебись же. Ошибка на тесте, близка на обучении.

Но вообще, процентов 90, что у меня именно high bias. Но если не трудно, накидай советов по тому и тому:3

Только простеньких, так как мне надо будет все писать руками

>А чем кстати плох high bias?

Тем, что величина ошибки не соответствует твоим требованиям. То есть алгоритм в целом отработал хорошо, но недостаточно для тебя, поэтому следует менять сам алгоритм - или набор фич (другую метрику), или же сменить простой knn на что-то другое.

Параметрически у knn все просто, меняешь k, меняешь баланс в bias/vaiance tradeoff. Если у тебя k строго 10, тебе это не подходит.

>Но если не трудно, накидай советов по тому и тому:3

Советов в интернете тонны и это самая азбука ML, это знать надо.

High bias: как я писал, это алгоритм хуево работает, и менять надо алгоритм, как полностью, так и увеличивать число фич. Underfitting.

High variance: алгоритм переобучается, и нужно или больше данных, или добавить регуляризацию, или уменьшитьчисло фич. Overfitting.

Спасибо! Очень понятно объяснил.

Число соседей менять можно, оптимальное у меня получилось 10. Но, скажем так если я выбираю 3 соседей я угадываю в 88 процентах случаев, а с 10 в 90 процентов случаев.

Метрики многие пробовал. Хорошо себя показал Жокар. Может есть в нетике йоба список метрик, а то я не нашел.

Она для тех, кто уже довольно глубоко в теме, на что недвусмысленно намекает нехилый вступительный экзамен. Рандомный хрен, вчера "решивший вкатиться", не сможет туда поступить.

Ну это не объясняет, почему вкатываться в 20 поздно. Можно за год-два полностью подготовиться к их экзу.

Ребят если я начну вкат с machine learning a probabilistic perspective, буду ли я писать, что-то годное к след году?

>Она для тех, кто уже довольно глубоко в теме, на что недвусмысленно намекает нехилый вступительный экзамен.

Нет там ничего ML-специфичного, знание матана и теорвера на уровне заборостроительного вуза. Теорвер проходится на третьем курсе, как раз 20 лет.

Рандомный хрен туда не сможет поступить, потому что планка намеренно задрана, а не потому что там такая охуенно сложная программа. Это традиционная наебка "элитных учебных заведений", в которой учат так же хуево, как и везде, но за счет отбора поступающих якобы формируются неебовые успехи, которые объясняются именно качеством преподавания.

Иными словами, у тех, кто способен поступить, и так в жизни проблем с трудоустройством не будет.

Думаю 18-ти летние школьники траллят.

Не думаю, что такие люди полезут в эту тему.

>Если ты к 20 все еще не определившийся олух, пытающийся куда-то "вкатиться" не имея о теме представления, то результат этих попыток очевиден заранее.

Вижу тупорылого юнца с таким же максимализмом.

То чувство, когда тебе 18, вкатываешься, а у тебя рак сердца.

Ну вкатился ты такой в 25, а у тебя начальнику 21. И ты для него говно, никто, червь.

Начинают с основ, но резко углубляются.

Если ты раньше с этим не сталкивался, совмещать с работой практически невозможно.

Так что если планируете, запаситесь свободным временем. В этом плане 20 летним корзинам легко.

Ну и пруфы на пике

Я бы мог сказать, что эта область имеет гораздо больше применений, чем очевидную возможность продать свою жопу дяде занидорага, да чувствую, что бесполезно. Впрочем, в тех рамках, что ML обсуждают ИТТ, наверное другие применения и невозможны.

Тупорылый проецирует. Нахуя идти работать к ебаным аутистам, для которых коллеги - никто? Такие фирмы - говно с хуевой атмосферой и долго не живут.

Дурик, чтобы работать на дядю, ML не нужно. Освой лучше станки с ЧПУ в любой шараге, бесплатно. К 20 годам зарплата будет намного больше, чем если освоишь машинное обучение.

А ты контингент в /pr/ видел? Презрение на презрении, ненависть на ненависти. Вот она, наша сфера, вот она!

"Вкат" это значит попасть на работу в данной сфере, желательно с неплохим окладом. Я для себя и приложеньице могу на андроид наклепать, и сайтик, но сказать что я вкатился в Андроид-дев или Веб-дев я не могу.

Хм, а если мне нравится ml? Если я хочу заниматься научной деятельностью в составе какой либо команды? А не только мутить лавеху? К такому повороту твои подростковые мозги небыли готовы?

Это со столетним опытом разве что. Стекломойные иваны и за двадцатку рады "работать", см. воркач.

Ты пишешь это разными словами каждый тред. Предлагаю уже добавить это в шапку.

Наука без денег не делается, браток. Пройдет хайп по МЛ, перестанут гранты давать - и не будет тебе никакой МЛ-науки.

За научной деятельнстью сразу ПхД, вокзал, Европа (или штаты). Самому с книжкой аутировать бесполезно, и никакие ШАДы тоже не помогут.

Приходишь ты такой к профессору, глаза горят, идей вагон, а на выходе - "где статья, сука, норматив по статьям надо, статьи статьи статьи список литературы в 150 позиций давай отфлюродросим всем импакт фактор гранты-хуянты"

Большая часть доски ищет работу в МЫ-ВАМ-ПЕРЕЗВОНИМ-ТРЕДЕ.

В МЛ сейчас модно, молодежно публиковаться в arXiv потому что вчерашние кодерки ниасиливают написать нормальную статью в журнал

Так и есть. Да такой сценарий возможен. Но если мы прям минимизируем риски, то тогда только в аграрный поступать или на врача, жрать и болеть люди не перестанут никогда.

>>864499

Ну надо же с чего начинать. Шад петухи кстати регулярно публикуются.

>>864503

Ну минусы есть везде. Тут ты прав. Другое дело, что лично для меня, плюсов всеравно больше.

Не, хабра не лучше, в архиве нужна рекомендация же. Но все равно говна через край.

Я это пишу разным людям, которые уверены, что ШАД это какая-то йоба, которая сделает из них людей, стоит туда только попасть.

В шапку, хуй знает, там сидит statistical learning дрочерство, которое я презираю.

>>864511

Вообще-то система arxiv+github+конференции - это самое охуенное, что случалось в ML за последние тысячу лет. Пока статистикопетушки ждут рецензии и публикации статьи (не публикую код, а то хули, спиздят же), deep learning бояре сегодня публикуют на архиве, завтра по всему миру их код на гитхабе ковырают сотни людей. Отсюда такая лавина исследований. Но хули, не модно же, давайте нам рецензируемые журналы, ведь без рецензента нельзя понять, какой процент ошибок на training и validation сетах у алгоритма.

А на хабре инвайт надо, или чтоб мод в песочнице увидел и вознёс. Плюс на хабре рейтинг будет видно, социум порешает, дичь опубликовали или нет.

Сразу контраргумент против "Хабра

это стадо быдла, а наука нет": В науке если ты делаешь что-то не в тренде, ты никто, над тобой все будут ржать (пока не окажется что ты там что-то сносное открыл в итоге), там такое же стадо.

>Плюс на хабре рейтинг будет видно, социум порешает, дичь опубликовали или нет.

Какой нахуй социум, там активно голосующих человек 100, и все поголовно пидарасы и долбоебы. Лучше просто на гитхабе выложить код, в readme.md закинуть идею, и на реддите в machinelearning забросить ссылку. Без инвайтов, да.

meh...

Согласен, код надо публиковать. Когда писали статью с науч.руком, я хотел выложить код в открытый доступ, но он запретил.

Вообще, работая со статистикой не леарнинг, я заметил, что обычно удаётся воспроизвести результаты только каждой пятой статьи. И мы не одни такие, проблема распространённая.

Это не проблема, для тех, "где статья, сука, норматив по статьям надо, статьи статьи статьи список литературы в 150 позиций давай отфлюродросим всем импакт фактор гранты-хуянты". Это суть работы, пилить без последствий.

Но благо, сейчас за дело взялись корпорации, которым вместо абстрактной науки нужны реальные результаты, с бабками.

лол ты где начальников 21 лвла видел маня?

виталика-педалика не упоминай даже, он папин аутист-программист один на миллиард

В модном стартапе, приехал такой в 21 с бородищей на гироборде и поясняет за МашОб.

Использует базворды, не способен пояснить за затухающие градиенты в RNN, от просьбы попробовать применить chain rule к производным начинает потеть и заикаться.

Просто ты, как и многие другие ничего не смыслящие в науке кадры, не понимаешь что такое пир ревью. Почему в прикладной математике непросто написать хорошую статью? Потому что надо показать значимость и новизну своей работы. Вся МЛная "лавина исследований" на самом деле гроша ломаного не стоит, потому что "я взял модель из [1], добавил еще 10 слоев и уменьшил ошибку на CIFAR на 0.00000001% по ставнению с SOTA" это не наука, а просто дрочильня ниочем.

опишу свой ШАД-икспиренс из далёкого года

знать надо нихуя примерно, СЛУ руками по гауссу 3его порядка и цепочечное правило (о существовании которого я тогда не подозревал) - максимум матана. половина задач чисто школьные.

на устном собеседовании было немного посерьёзнее правда.

а вот учили вполне жёстко. в универе (не самая шарага) я не испытывал никаких проблем с матаном, но на тамошних лекциях по теорверу Ширяева просто охуевал. сидящие рядом девочки с мехмата правда вроде не особо напрягались, хз.

лекции по мл червоненкинса были норм по сложности, но в домашке были жёсткие подьёбы навроде неразделимых классов в задаче где предполагалась голая свм.

на теории игр от буниной все расслаблялись - уровень был просто школьный.

> в жизни проблем с трудоустройством не будет.

сижу без работы 3 года, не берут даже веб-макакой. все хр-бляди должны здохнуть.

Очевидно что самое дно набирать не нужно. Готов пройти собеседование, ну или провести.

коммитер в scikit-learn

Идею поддержу, но не более. Задач выше крышы, я скоро свихнусь от этого дерьма.

поясните нюфагу за вторую картинку

чоза икс-омега, нифига не понял

>>864854

>телеграмме

нынче матрикс же доделали: riot.im

да, конечно

Ты же знаешь, что такое arxiv.org? Это препринт сервер, туда кидают статьи, чтоб их сразу читали, пока ревьювятся в журнал. Если какой-то васян закинул туда свою статью, его все равно дальше абстракта никто читать будет. Читают людей с именами, имена получаются через конференции. Все стоящие ученые кидают свои статьи на архив. Архив.орг как бе не отменяет традиционные журналы.

Я имел в виду тех, кто только в архив кидает. Хотя и на конференциях средний уровень не оче, а журналов мало.

В чем по сути заключается "лавина исследований"? Несколько тысяч человек за три года затерли то дыр 3.5 датасета с картинками, вот и вся эта лавина. По-настоящему инновационных статей совсем мало, в основном от дипмайнда, да и то по большей части чисто инженерная работа по доведению до ума предыдущих идей, например альфаго. Причем дипмайнд все свои норм работы в нейчер шлет, а не на архив.

Блять. Ещё и правила нард учить. Ок. Спасибо. Сегодня поищу.

> Видя, что машинное обучение это все в моде сейчас я решил несколько месяцев назад, чтобы перейти в шумиха поезд и посмотреть, где что взял меня. Но вскоре я обнаружил, что это не было похоже на изучение нового рамки JS или следующий магическое решение CI, но больше как целый новый мир головных болей и возможностей, которые сделали бы меня заново оценить, как я подходить к решению проблем все вместе.

> Как разработчик, обнаруживая, сколько абстрактное мышление и статистика происходит в ML был как можно ближе к пощечине, как он получает, но, как кто-то, кто не знает, когда остановиться, я продолжал достижения этой цели шахты.

> Машинное обучение походит на лицейного секса. Все говорят, что они делают это, на самом деле никто не делает, и никто не знает, что это на самом деле

люблю когда высокомерный буржуа немного обкакунькался

Ну, сначала хочу изучить проблему, попутно читая гугл уже, не особо успехи, но может вы сразу определите мои подводные камни? Как и что делать, с чего начать?

было на реддите неделю назад

https://www.reddit.com/r/LanguageTechnology/comments/570da2/any_ideas_on_how_to_go_about_programmatically/

Если нейроночки, то ворд2век плюс лстм, а так, как на реддите написали, всяких n-gram и марковых цепей хватит

Ок, благодарю. А вообще, на сколько это трудоемкая задача? А то это курсовая как бы.

>Почему в прикладной математике непросто написать хорошую статью? Потому что надо показать значимость и новизну своей работы.

Ну кому ты пиздишь. 99% шлака без новизны везде, и в журналах, и в препринтах. Разница в том, что виде препринта шлак отсеивает компьютнити за день, а в журналах этот шлак публикуется и навешивает лычки на автора, от которого зависят его бабки. Поэтому именно для журналов пишут одну и ту же идею по 10 раз, и прочитал одну статью автора - прочитал все (как минимум, на ближайшие несколько лет). И весь этот кайф еще и денег стоит.

>Вся МЛная "лавина исследований" на самом деле гроша ломаного не стоит

Да, да, именно поэтому statistical learning побеждает слесарей на kaggle, а на его базе делают стартапы, а задача классификации приблизилась к мозгу. Потому что так анон сказал.

На самом деле нет.

Нейроночки сейчас превращаются в науку типа химии, когда изначальная физическая база поменяется своими законами, которые более удобно использовать конкретным образом. То, что это аутистам-математикам не нравятся, так пусть идут они нахуй дрочить свою теорию струн.

>это не наука, а просто дрочильня ниочем.

Угу. Вот тебе пример дрочильни:

>Не имея лаборатории и работая в помещении институтской кладовки, а позже в сарае на улице Ломон в Париже, с 1898 по 1902 годы супруги Кюри переработали восемь тонн уранинита.

Вот тупые-то.

Это и есть наука. Исследовал, проверил, поделился (с обязательным воспроизведением). Шлак получился - ну это тоже результат, на то она и наука, что иногда нужно и 8 тонн говна переработать. Но шлак тоже стоит опубликовать, чтобы другие не тратили время на то же самое.

А статьи в журналах, в которых специально создают недомолвки, чтобы потом подороже продать свои идеи, и конечно же без кода, вот это не наука, а меркантильное дерьмо, которое мы и наблюдаем по $30 за статью, а также глядя на успехи "математиков" в задачах.

>>865181

>В чем по сути заключается "лавина исследований"? Несколько тысяч человек за три года затерли то дыр 3.5 датасета с картинками, вот и вся эта лавина.

Бредятина. Ты описываешь только одну конкретную задачи классификации, которая действительно уперлась в поток за последние годы, но только потому, что за 2010-2015 она взлетела в небеса. Для residual сетей по сути imagenet'а недостаточно. При этом датасеты просто служат для повторяемости измерений, а у тебя звучит так, что дело в том, что исследования специально подкручивают под датасет.

Но задач-то дохуя, от близких к классификации image2vec, до генерации изображений, super resolution, удалением шума, и кучи другой хуйни. И это только изображения, есть еще анализ текстов, звуков, и такая же их генерация. И везде охуенные результаты.

Из последнего, быдло увидело рисование хуев на картинках, но на деле это основано на открытии охуенного метода генерации изборажений.

> По-настоящему инновационных статей совсем мало, в основном от дипмайнда

Да ты жертва пиара просто. От гугла собственно научной инновационности не так много, в основном я вижу оверинжиниринг уже существующих идей, которые ты как раз не любишь. Сравнить, например VGG-19 и Inception. Первая - красота вообще, а вторая - ну так, оптимизация вычислений. И что на слуху у быдла типа тебя? Швитой гугл конечно же.

Вот я открою ща arxiv-sanity и перечислю, что там было.

Бинаризация сетей (когда веса сводятся к -1 и 1 и это работает) да и вообще в целом способы сократить потребление ресурсов, residual сети (и их сведение к RNN сетям) - охуенно, batch normalization, style transfer в рилтайме, DCGAN. Почти все 2015-й год. В 16-м еще кучу всего охуенного завезли.

>Почему в прикладной математике непросто написать хорошую статью? Потому что надо показать значимость и новизну своей работы.

Ну кому ты пиздишь. 99% шлака без новизны везде, и в журналах, и в препринтах. Разница в том, что виде препринта шлак отсеивает компьютнити за день, а в журналах этот шлак публикуется и навешивает лычки на автора, от которого зависят его бабки. Поэтому именно для журналов пишут одну и ту же идею по 10 раз, и прочитал одну статью автора - прочитал все (как минимум, на ближайшие несколько лет). И весь этот кайф еще и денег стоит.

>Вся МЛная "лавина исследований" на самом деле гроша ломаного не стоит

Да, да, именно поэтому statistical learning побеждает слесарей на kaggle, а на его базе делают стартапы, а задача классификации приблизилась к мозгу. Потому что так анон сказал.

На самом деле нет.

Нейроночки сейчас превращаются в науку типа химии, когда изначальная физическая база поменяется своими законами, которые более удобно использовать конкретным образом. То, что это аутистам-математикам не нравятся, так пусть идут они нахуй дрочить свою теорию струн.

>это не наука, а просто дрочильня ниочем.

Угу. Вот тебе пример дрочильни:

>Не имея лаборатории и работая в помещении институтской кладовки, а позже в сарае на улице Ломон в Париже, с 1898 по 1902 годы супруги Кюри переработали восемь тонн уранинита.

Вот тупые-то.

Это и есть наука. Исследовал, проверил, поделился (с обязательным воспроизведением). Шлак получился - ну это тоже результат, на то она и наука, что иногда нужно и 8 тонн говна переработать. Но шлак тоже стоит опубликовать, чтобы другие не тратили время на то же самое.

А статьи в журналах, в которых специально создают недомолвки, чтобы потом подороже продать свои идеи, и конечно же без кода, вот это не наука, а меркантильное дерьмо, которое мы и наблюдаем по $30 за статью, а также глядя на успехи "математиков" в задачах.

>>865181

>В чем по сути заключается "лавина исследований"? Несколько тысяч человек за три года затерли то дыр 3.5 датасета с картинками, вот и вся эта лавина.

Бредятина. Ты описываешь только одну конкретную задачи классификации, которая действительно уперлась в поток за последние годы, но только потому, что за 2010-2015 она взлетела в небеса. Для residual сетей по сути imagenet'а недостаточно. При этом датасеты просто служат для повторяемости измерений, а у тебя звучит так, что дело в том, что исследования специально подкручивают под датасет.

Но задач-то дохуя, от близких к классификации image2vec, до генерации изображений, super resolution, удалением шума, и кучи другой хуйни. И это только изображения, есть еще анализ текстов, звуков, и такая же их генерация. И везде охуенные результаты.

Из последнего, быдло увидело рисование хуев на картинках, но на деле это основано на открытии охуенного метода генерации изборажений.

> По-настоящему инновационных статей совсем мало, в основном от дипмайнда

Да ты жертва пиара просто. От гугла собственно научной инновационности не так много, в основном я вижу оверинжиниринг уже существующих идей, которые ты как раз не любишь. Сравнить, например VGG-19 и Inception. Первая - красота вообще, а вторая - ну так, оптимизация вычислений. И что на слуху у быдла типа тебя? Швитой гугл конечно же.

Вот я открою ща arxiv-sanity и перечислю, что там было.

Бинаризация сетей (когда веса сводятся к -1 и 1 и это работает) да и вообще в целом способы сократить потребление ресурсов, residual сети (и их сведение к RNN сетям) - охуенно, batch normalization, style transfer в рилтайме, DCGAN. Почти все 2015-й год. В 16-м еще кучу всего охуенного завезли.

тот метод с реддита по частям речи тоже звучит ок, его тоже можешь посмотреть.

Зависит от того, насколько у тебя хорошие данные, сколько их у тебя, насколько хорошо знаешь питон и тд и тп.

Сложность варьируется от import tensorflow за две минуты до месяцев красноглазия в попытках набрать 64 процента точности.

Но я у мамки слесарь, поэтому послушай пацанов поумнее, мб, кто-то что-то еще посоветует

Пока ничего нет, питон видел пару раз. Изложу свои мысли преподу, а там посмотрим. Проблема в том, что она может загнать меня в самые ебеня, и потом придется все разгребать, либо наоборот ничего дельного не скажет, что более вероятно. Так что буду доебываться до людей на двачах и во всяких конфочках, вот.

Мимопроходил и заинтересовался.

>Почитал статью и как потратил время зря, потому-что в итоге вроде всё понял, но как автор писал реализацию / какие гиперпараметры - не ясно.

Не трать вермя на статьи без кода вообще, полно хороших статей с кодом. Если лень гуглить, вообще можешь читать только один gitxiv.

Но если ты будешь смотреть только код, ты поймешь еще меньше. Просто с опытом ты начнешь отделять воду, которая кочует из статьи в статью, от сути, которая часто сводится к нескольким абзацам концентрированного текста.

Photo-Realistic Single Image Super-Resolution Using a Generative Adversarial Network

Ну блядь, вообще застой в индустрии.

Довольно очевидным образом. Это ответ, почему мозг не deep, а работает на уровне ResNet с 1000 слоев.

https://arxiv.org/pdf/1604.03640v1.pdf

Визуальная кора является deep in time, имея небольшое число физических слоев, эмулируется больше число слоев за счет обратной связи. Или наоборот, ResNet эмулирует мозг, разворачивая RNN в пирог из 1000 слоев - это как тебе удобнее. Открытие охуенное, потому что становится понятнее, как мы устроены, и это все - сегодняший день.

Это все мы тут. Не слесари сами разрабатывают методы.

Охуенчик. Бочку нефти тебе, анон.

Я нихуя не понял.

Что надо прочитать, чтобы иметь возможность хотя бы генерировать респонс "вау, охуеть, вот это круто!" на подобные посты?

>Визуальная кора является deep in time, имея небольшое число физических слоев

>это все - сегодняший день.

ну плиз

сто лет назад это выяснили

Новый положняк. У кого на Kaggle рейтинг ниже 20 - чуханы-чуханчики, меняйте профессию пока не поздно.

Надо следить за state-of-art решениями начиная с AlexNet и понимать, в чем заключается их новизна. Тогда реакция "вау, круто" была бы сначала на ResNet, а потом вот на это объяснение, почему оно работает. Вот почитай.

https://adeshpande3.github.io/adeshpande3.github.io/The-9-Deep-Learning-Papers-You-Need-To-Know-About.html

Но кегля - это лишь зачет для слесарей.

>>866680

Оппост и дальше быть в струе на реддите. Только на определенном уровне просветления ты поймешь, что это не так уж и круто и по большей части просто очередной кодерский манямирок, наподобие того как в 60х думали, что создав шахматную программу мы поймем, как мыслит человек.

>Только на определенном уровне просветления ты поймешь

А потом пойдешь хлебать мамкин борщ. Ты своим пафосом напоминаешь любителей хаскеля, у которых тоже какие-то невнятные понты при полном отсутствии успехов.

Читайте оппост, пацаны, будете такими же, воможно, даже вас возьмут в банк классифицировать заемщиков.

Где у меня пафос? Пафос это когда вчерашний кодер от сохи прочитал про слои и решил, что теперь он знает, как работает мозг. А это не пафос, а трезвая оценка состояния дел в науке, и это не я придумал, естественно, а светила сами так говорят. См., например, выступления ЛеКуна (жаль, он книгу не напишет по этой теме).

Собственно в той литературе ничего про диип лернинг нет, но она задает необходимый бэкграунд и настроение ума. Так что это только начало, дальше ты сам должен понять, что нужно читать и почему.

Если не хочешь идти в банк и никого классифицировать, не читай книги из оппоста, потому что там научат тебя именно этому.

> А что тогда читать?

А чего ты хочешь? Некоторые и от книг Донцовой ловят ваукруто, и им норм.

Нет, а ты?

Лолшто?

Прочел Ли и Витани от корки до корки. ИМХО это одно из самых "недооцененных" достижений математики: немногие знают эту теорию, а ведь она затрагивает широчайший спектр областей, от философии науки до машинного обучения. Книга серьезно повлияла на мое мировоззрение.

Софт-вей, это http://cs231n.github.io/ плюс руками пишешь свою нейроночку, потом читаешь про recurrent neural networks, потом про residual neural networks, потом читаешь ту статью, которую запостил анон и говоришь ВАУ. На все, про все у тебя уйдет от двух недель до месяца.

Так и тут, статистикодрочеры годами изучают мат. модели, которые с трудом вмещаются в голову, а потом нейроночка за день (в редких случаях за месяц) строит более эффективную модель. И тут начинается МИКРОКОНТРОЛЛЕРЫ НЕЙРОНОЧКИ НЕ ТРУЪ, ДИДЫ СЧИТАЛИ НА БУМАЖКЕ И МЫ ДОЛЖНЫ, KAGGLE ДЛЯ СЛЕСАРЕЙ.

Но кегля действительно для слесарей, собственно они этого и не скрывают. Никто не делает исследований на кегле.

Если ты не умеешь считать на бумажке, то ты не понимаешь и нейроночек, а просто как вебмакака копируешь примеры из интернета. То есть ты почти бесполезен, испортить тензорфлоу эс тф можно научить любого за короткий срок. В чем тогда твоя ценность как специалиста, подумой.

Вот, скажем, захотел я сделать нейросеть для игры в крестики-нолики и заставить ее играть против классического алгоритма, способного если не выиграть, то сыграть партию вничью. Цель — научить нейросеть не проигрывать хотя бы в 75% сыгранных партий. С чего вообще нужно начинать? Как выбрать нужную архитектуру? Как объяснить нейросети правила игры, например то, что нельзя ходить в уже занятую клетку поля?

слишком хуита, очень маленькое пространсво состояний, тривиально перебирается

можно сделоть примерно любым алгоритмом, даже самым бредовым

придумай обобщение крестиков-ноликов на непрерывное пространство хотя бы

Спасибо.

Ладно тогда.

Сложные модели это не очень у них слишком высока ёмкость, + сложные модели не интерпретируемы.

Где-то было про Abbyy и про то как они не используют ничего сложного в своих OCR, ибо важна очевидность модели.

А также распространён способ когда ищут минимум исходной функции f поиском нуля её производной (С помошью гессиана f'').

Никогда вторым способом не пользовался. Почему есть смысл считать/оценивать приблизительно вторую производную (гессиан) для решения той же задачи? Не вижу профитов.

Читай про методы оптимизации. Там десятки методов, первого и второго порядка. Последние лет 60 это активно разрабатывалось все.

все методы ищут ноль производной

Телемастер как есть. Нейросеточки не интерпретируемы, поэтому нужно как деды делать то, что в узкий мозг телемастера влезает.

Уже нашел, спасибо.

А теперь прикинь, продал ты свой продукт богатому дяде. Дядя приходит и "Чет хуйню выдавать начал, почини!" а ты "А я блин не знаю как оно работает!". Это я про ABBYY.

А ты включаешь в тренировочный датасет случай, на котором начало хуйню выдавать и его аналоги. И говоришь богатому дядьке "с вас 1.5kk за сопровождение".

ABBYY как раз и есть пример старперов, у которых все хорошо и бизнес налажен, и ничего менять не хочется. Это называется луддизм.

>>867686

Там про что? Конструктивный/интуиционистский подход к вероятности штоле? Неужели. Еще немного и додумаются до конструктивного изложения нечетких множеств.

Там про определение сложности объекта, и определение количества информации как величину сложности описания объекта. Эти же понятия можно использовать для определения алгоритмической вероятности, которая даёт универсальные приоры. На базе этого можно построить универсальный алгоритмический интеллект.

Беда теории в вычислимости даже самых базовых вещей, из-за чего она кажется очень непрактичной. Но сама по себе она очень интересна.

inb4: игра в бисер, нинужна, сложна

>определение количества информации как величину сложности описания объекта.

Есть жи энтропия Шеннона.

Алсо, это где-то реализовано для анализа данных? Вот это оно или нет - https://cran.r-project.org/web/packages/acss/acss.pdf http://complexitycalculator.com/methodology.html

Которая есть усреднённая Колмогоровская сложность.

Здесь взгляд с другой стороны. Колмогоровская сложность рассматривает возможные программы и возможные опорные машины, на которых эти программы работают.

>>869149

Колмогоровская сложность невычислима. Обычно к алгоритмической теории информации обращаются, когда рассказывают про принцип минимальной длины описания, BIC и связанные с этим практические вещи.

По ссылке что-то похожее на аппроксимации.

Можешь погуглить аппроксимации AIXI.

>аппроксимации AIXI.

Для R нету. Но вот это жи http://journals.plos.org/plosone/article?id=10.1371/journal.pone.0096223 тоже аппроксимация колмогоровской сложности?

>Которая есть усреднённая Колмогоровская сложность.

Но если это типа шенноновской энтропии, то с чисто практической точки зрения, намного ли лучше эта ваша аппроксимация колмогоровской сложности? Т.е. есть ли заметный выигрыш при анализе данных, или просто разница в доли процента?