Это копия, сохраненная 10 июля 2016 года.

Скачать тред: только с превью, с превью и прикрепленными файлами.

Второй вариант может долго скачиваться. Файлы будут только в живых или недавно утонувших тредах. Подробнее

Если вам полезен архив М.Двача, пожертвуйте на оплату сервера.

Тред #2: https://arhivach.org/thread/170611/

Machine Learning 101:

1. Introduction to Statistical Learning, Casella ( http://www-bcf.usc.edu/~gareth/ISL/ISLR Sixth Printing.pdf )

Читается легко, неплохая разминка перед ESL

2. Pattern Recognition and Machine Learning, Bishop.

3. Bayesian Methods for Hackers. Введение в байесовские методы, годно.

4. http://neuralnetworksanddeeplearning.com

Введение в нейронные сеточки для самых маленьких. Написано простым английским.

5. https://yandexdataschool.ru/edu-process/courses - базовые курсы ШАДа.

Machine Learning Advanced

1. Elements of Statistical Learning (http://statweb.stanford.edu/~tibs/ElemStatLearn/printings/ESLII_print10.pdf )

Сложность - 9 из 10. Шутки в сторону, можно читать годами. Если вы сможете полностью проработать эту книгу и прорешать упражнения, обязательно свяжитесь со мной - у меня найдется работа для вас.

2. Optimization for Machine Learning. Edited by Suvrit Sra, Sebastian Nowozin and Stephen J. Wright, MIT Press, 2012.

Иногда from sklearn.linear_model import LogisticRegression перестает работать и тогда нужно все переписать. Оптимизация квадратичных приближений на больших объемах данных, разреженные модели, суррогатные оптимизации - вот это все тут есть.

3. http://www.cs.nyu.edu/~mohri/mlbook/

Как ESL, только слегка по-проще. Попробуйте, может зайти.

Дальше вас ждет дикий и необузданный мир. Два маяка https://vk.com/deeplearning и http://deeplearning.net/reading-list/ осветят дорогу: это списки литературы и обзоры статей для прощупывания пульса индустрии.

Computer Science

1. Intoduction to Algorithms, Corman

2. The Art of Computer Programming, Knuth

3. Compilers: Principles, Techniques, and Tools. Разработчикам компиляторов и прочим авторам убийц питонов и крестов посвящается.

4. Введение в информационный поиск, Кристофер Маннинг.

Как работает поиск с теоретической точки зрения.

Programming

1. Python Unlocked. Короткая книжка без соплей. В ней описаны метаклассы, дескрипторы, системы типов, шаблоны проектирования и TDD. Всего чуть больше 100 страниц концентрированной сути.

2. Code Complete (2nd), McConnel.

Неплохая книга. Не то чтобы обдрочиться, но в голове всякие фишки по структуризации кода и его проектированию остались.

Misc

1. Telegram: @techsparks

Подкаст про всякие гик-штуки.

F.A.Q

По мотивам предыдущего треда.

Эти ваши книжки стоят овер 9000 рублей, как быть?

http://libgen.io

Книги хорошо, но с чего начать практический вкат?

Во-первых, вам нужна любая unix-based система. На Windows возможно запустить нижеперечисленное, но ждите пердолева с настройкой и неодобрительных взглядов анонимуса. Кроме того, в компаниях, так или иначе связанных с разработкой йоба-ПО и machine learningом, Linux/OS X является стандартом. Привыкайте.

Во-вторых, определитесь с языком. Python и C++ наиболее мейнстримовые инструменты, с ними вы без еды не останетесь. Есть еще R, на котором пацаны живут статистикой и анальными пакетами. Некоторые инструменты являются языко-независимыми (Vowpal Vabbit, XGBoost), но обвязывать их вы все равно будете из какой-либо среды.

На Java разработано много production-ready инструментов для бигдаты и если вы угораете по терабайтам данных, то имеет смысл посмотреть в её сторону. Впрочем, лучше это делать уже потом, когда прийдет осознание потребностей.

В-третих, выбирайте себе задачу. Что угодно: распознать качпу, обнаружить ботов по логам, найти раковых больных. Список можно посмотреть, например, на kaggle.com. После чего приступаете к решению выбранной задачи.

Не прийдется ли мне потом с таким наборищем знаний идти в макдак работать?

Несмотря на хайп вокруг ML, далеко не во всех IT компания есть необходимость в ML и понимание круга задач, которые можно решить этими методами. Но поверьте, в 2016 компетентный специалист будет востребован. В России потребителями ваших знаний могут стать: Яндекс, Mail.ru, Вконтакте, Rambler, Касперский, Билайн, Связной, ABBYY, Хуавэй. В биоинформатике есть определенный спрос, можно поскролить http://blastim.ru

Здорово, но я так и не понял чем же вы занимаетесь в IT компаниях?

Попытаюсь ответить со своей колокольни и сразу хочу предупредить, что это едва ли консенсуальное мнение.

ML-специалист - это такое зонтичное определение для человека, способного увидеть проблему, выгрепать кучу логов и данных, посмотреть на них, придумать решение проблемы и врезать это решение его в продакшн. По сути, это кодер, решающий не чисто технические, а, в некотором роде, человеческие проблемы.

Имхо, мы все же остаемся в первую очередь разработчиками.

Но ведь есть Machine Learning per se, чем он занимается?

Действительно есть. Одаренная прослойка людей изобретает новые методы, но это правильнее называть просто математикой. Сейчас пищей для ума являются нейронные сети и их возможные архитектуры, но даже они двигаются рука об руку с практикой.

Что такое TensorFlow?

TensorFlow - часть гуглового инструмента для перемножения тензоров и оптимизации функционалов. Часть - потому что важные куски типа паралелизации еще не выкачены в паблик. Если вам все ещё непонятно что это, значит это вам и не нужно, сириусли. Google перестарался с рекламой и теперь люди думают, что TF - это серебряная пуля и затычка для каждой бочки. До TF был Theano, который выполнял свою работу не хуже. И, в отличии от TF, он уже находится в стабильной фазе.

Расскажите мне, например, как нейронная сеть научится управлять обратным маятником?

например так

эволюция связей и весов нейросетевого графа

https://www.google.ru/search?q=neat+pole+balancing&oq=neat+pole+balancing&aqs=chrome..69i57.10776j0j1&sourceid=chrome&ie=UTF-8

Он что, просто подождет, пока маятник придет в норму и обратно восстановит баланс?

Функция приспособленности для обратного маятника принимает свой максимум при 0 угле наклона и 0 дельте угла наклона, как-то так. Остальное - рандомный поиск в пространстве состояний угла наклона и его дельты. Но вообще говоря, стабилизировать обратный маятник генетическим алгоритмом - аутизм какой-то.

http://ftp.funet.fi/pub/sci/neural/cns-bbs/annsim/togai.lzh

Ну, обычный поиск значений и запоминание их куда-либо

Сначала бы с разрешением окулус рифта разобраться.

Сначала бы нормальную анимацию в нем сделать.

Сначала бы нормальную передачу движения сделать

Сначала бы в нормальную нейронную сеть суметь хотя я не понял, зачем она тут

Короче, мы не умеем ни во что из того, что ты хочешь

Ведь это пиздец непросто.

Знаешь, сколько конструкционных заморочек?

А ведь надо заморочиться так, чтобы потом не заморачиваться.

И когда делаешь что-то сам и впервые, то все по другому, тебе никто не скажет, почему у тебя тут нечеткая логика работает так, что сервопривод не доходит на 4 см, а по расчетам все вообще верно?

Или как бы сделать ей систему торможения, чтобы ее не колбасило моментом инерции?

Или как сделать нормальную амортизацию в коленных суставах и тазобедренном шарнире?

А зачем нейросеть? Просто датчики на скафандре и манкене сканируют и передают те же движения манекену, а через окулус и манекен поступает инфа о расстоянии до тела.

Извини не туда написал, хотел тебе ответить что-то другое.

Какие датчики? Как настраивать их точность? Как их калибровать? Как их размещать? Как их запитывать, какая архитектура, вид платы?

Есть же аналоги таких роботов, действующих по движениям. Я лично для себя подумал, что можно изменять угол сгиба скелета в трехмерном пространстве (т.е. три оси координат). И на его основании моделировать положение тела. Расстояние между манекеном и скелетом человека можно измерять с помощью датчиков, ну как на тачках, который расстояние до парковки измеряют лол. А там от какой-то одной точки выстраивается аналогичная модель скелета оппонента трехмерная.

>какая архитектура, вид платы?

Я вот не силен в роботехнике и компьютерных железках, я просто быдлокодерок, но наверняка серьезные фирмы запилят машину для такого устройства с соответсвующей платой-кодом-архитектурой. Может даже свой язык запилят под это дело.

Для классификаторов сейчас используется почти исключительно кросс энтропия. Там через логарифмы пропускают выход.

Для НС крайне важно, чтобы функция цены имела хорошие производные. Абсолютно необходимо, чтобы цена от Х примеров была суммой цены по всем примерам, иначе и производную считать геморно, и на батчи не разложишь, т.е. это вообще ни в какие ворота. "Странные" функции, которые ты перечислил, по-моему этим свойством не обладают.

Кросс-энтропия, средние квадраты и еще несколько обладают всеми нужными свойствами. Однако см. также недавние работы по аутоэнкодерам, в частности variational autoencoder, generative adversarial networks. Там как раз борются со среднеквадратичной ошибкой, т.к. по ней выходит, что если у стола может быть она нога или четыре, то оптимально предсказывать 2.5. На эту тему много исписано, но думаю что в 70-х годах о таком еще никто и не подозревал.

Для классификаторов обычно используют F1-score.

дискас

А как надо, точе́чная о́ценка?

Нам платят не за время, а за модели. 5руб. за каждый натренированный параметр.

MCMC кормит меня хуями.

В mean field не получается ввести сопряжённые приоры.

Particle Loopy BP не сходится.

Есть ещё какие-нибудь общеизвестные варианты?

Мб, анон наставит на путь истинный?

Это уже все известно и не работает нормально и эффективно.

>>754207

>Может

>наверняка серьезные фирмы

Ну ты сам понял

> MCMC кормит меня хуями

не может быть

То есть?

нет же, с каждым твитом от дипмайнда интерес все больше разогревается

https://www.google.com/trends/explore#q=machine learning, deep learning&date=1/2010 77m&cmpt=q&tz=Etc/GMT-2

Ну всеравно это интереснее, чем быть макакой. Да и порог входа тут выше, хотя и требуется меньше.

Мойдодыр! Принимайте пополнение!

Знаю что такое p.value, нормальное распределение, анализ выживаемости, могу в r сделать кластерный анализ, построить регрессию, немного могу knn, gbm, деревья классификации.

Где мне стелить? У окошка с авторитетами, на параше или к мужикам пока?

>Где мне стелить? У окошка с авторитетами, на параше или к мужикам пока?

Есть две НС. В одной 200 слоев по 50 нейронов, а в другой 50 слоев по 200 нейронов. Какую сам будешь использовать, какую матери отдашь?

Матери 200 слоев. Хотя хз что там в ваших нейросетях.

>>755481

> Что не так?

С частым false positive.

Почитай про критику p value. Некоторые журналы даже не принимают статьи, где они используются.

http://arxiv.org/pdf/1605.07912v2.pdf

Спасибо

я бы тебе anal prpagation устроил.

https://www.youtube.com/watch?v=2pWv7GOvuf0&list=PL5X3mDkKaJrL42i_jhE4N-p6E2Ol62Ofa

Кто как изучал RL?

> The difference between Adaline and the standard (McCulloch–Pitts) perceptron is that in the learning phase the weights are adjusted according to the weighted sum of the inputs (the net). In the standard perceptron, the net is passed to the activation (transfer) function and the function's output is used for adjusting the weights.

Курс Сильвера мне показался сложным. Рекомендую 5 и 6 недели этого:

https://courses.edx.org/courses/BerkeleyX/CS188x_1/1T2013/info для плавного въезда в RL.

Веса настраиваются по-разному штоле? Вроде и там и там обратное распространение ошибки, не?

Ага. спасибо.

У меня в шаражке уже было два семестра с ИИ, так что какая-то минимальная база у меня есть.

ADALINE линеен. В русской литературе это называется "адаптивный линейный сумматор", емнип.

У тебя на втором пике ошибка идёт до активации выхода, в перцептроне после.

На втором пике м.б. дядя намудрил. На схеме-то немного не так.

Почему гугл еще не выдал более менее нормальный переводчик на основе deeplearning?

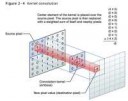

>как правильно делать сегментацию.

В сверточных сетях и неокогнитроне она автоматически делается. А вообще, должно быть достаточно, если на картинке кроме самой цифры ничего нет.

Я понимаю, что можно одну картинку прогонять с разной вырезкой по координате и найти ее оптимальное начало и длину и высоту, но есть же способ сразу получить их.

У тебя опять сигнал ошибки до активации идёт.

Ты сам гуглить то пытался, нет?

https://www.quora.com/Artificial-Neural-Networks-what-is-the-difference-between-perceptron-and-adaline-in-recognition-+-and-X-images

https://en.wikipedia.org/wiki/ADALINE

Ну смотри, на пикрелейтед "учитель" оценивает выход адалайна после активации, после чего правит в консерватории, если выход неправильный. Правятся-то веса модели, а не сам сигмоид. По второй ссылке одни общие фразы кроме

>The only difference is that the adaline, after each iteration checks if the weight works for each of the input patterns; the perceptron just updates the weight after each new input pattern and does not go back and check.

бамп вопросу

https://www.youtube.com/watch?v=jQg8p-V8jF4

Ну хуй знает. Может быть вейвлеты какие-нибудь помогут, может быть главные компоненты, может быть аутоэнкодеры. Вряд ли есть способ сделать это проще чем в сверточных сетях.

лучше сразу поставь убунту и не еби мозг всем.

Или например, вычислить формулу, по которой качаются качели?

Да, может. Это называется идентификация системы. Только в нейросети результат непрозрачен, весовые коэффициенты тебе не дадут ничего. Интерпретируемый результат возможен при использовании например нечетких моделей. Вычислить формулу сложнее, но это тоже возможно. В совке еще был разработан такой метод как МГУА (метод группового учета аргументов, GMDH). Частный его случай - полиномиальная нейросеть. Подобными алгоритмами можно прямо восстанавливать формулы по входным-выходным данным системы, подробнее например http://gen.lib.rus.ec/book/index.php?md5=E73366E46C7B2375264EA47C1C09F4C5 там есть пример восстановления по данным т.н. соотношений Онзагера https://ru.wikipedia.org/wiki/Теорема_Онзагера но эти алгоритмы в своем изначальном (а не обрезанном) виде нигде не реализованы, и в массе своей существуют в виде еще совкового кода на фортране разной степени допиленности.

Ну, вычислять формулу не надо, главное - искать взаимосвязи.

А совковский код - очень даже интересно, в этом направлении еще никто не работал, если не ошибаюсь?

Может себе дипломник взять по этой теме?

>главное - искать взаимосвязи.

Тогда идентификация систем. Аппроксимация функций зависимости выходов от входов. Тема известная и широкая. Основная проблема - интерпретируемость полученной модели, но тут тоже есть свои подходы. А эти совеццкие алгоритмы вещь вообще малоизвестная, сейчас смотрю даже сайт http://gmdh.net/ где весь код был выложен, помер.

Лол, поехавший >>760789 в треде, я спокоен.

Хм, очень даже интересно.

А если у меня задача не в классификации, а в том, чтобы идентифицируемую систему, нейронная сеть составила сама.

>чтобы идентифицируемую систему, нейронная сеть составила сама.

Это как? Система - это некий реальный объект или их совокупность. Качеля та же. Есть некие действия (входы), на которые система отвечает (выходы). Допустим, нам не известны принципы ответа системы на внешние воздействия. Но есть возможность измерить как воздействия так и ответ системы. Вот по этим данным можно построить модель системы, что и составляет идентификацию.

Я об этом и говорю. Любая такая взаимосвязь есть функция зависимости выходов от входов. Задача в том чтобы такие функции выявить. Это и есть идентификация системы. Которая решается с помощью универсальных аппроксиматоров функций.

>функция зависимости

Ты рили немного поехавший, лел.

>Задача в том, чтобы такие функции выявить.

Ну это понятно, но как такое реализовать? Может использовать несколько нейросетей? Или есть архитектура сети, умеющая в такое?

Ведь нужно искать не только взаимосвязь между данными, но и исключения.

Вообще, можно представить все в виде области значений из точек.

Такое в Картах Кохонена вроде реализовано, но они старые.

Ох, а правда.

Как научить нейронную сеть считать упреждение?

Как научить ее предсказывать точно колебания маятника?

И платина:

Может ли нейронная сеть научить шагоход ходить?

И чтобы сеть не имела изначально никакой информации, а сама все узнала, подбирая методы.

у царя был двор,

на дворе был кол,

на колу мочало;

не сказать ли с начала?

Есть ли сети, которые могут сравнивать и классифицировать информацию только потому, что в процессе обучения без учителя получают награждение, например?

Ты про нечёткие модели забыл.

а ты можешь держать равновесие двух длинных палок одновременно ?

а нейронка может (ну как минимум с помощью td\Q обучения)

В меня сейчас будут кидаться немытыми хуями перельмана, но предлагаю порассуждать о нейронках с точки зрения психологии.

И вопрос господам когнитивистам, зачем нам внимание ?

Для перераспределия вычислительных ресурсов ?

>а ты можешь держать равновесие двух длинных палок одновременно ?

Могу, я же тоже нейронка, лел.

>В меня сейчас будут кидаться немытыми хуями перельмана, но предлагаю порассуждать о нейронках с точки зрения психологии.

Чистый вычислительный механизм.

Порассуждай еще о синусе с точки зрения психологии, одно и тоже.

Кстати, а это уже интересно.

https://github.com/MaxwellRebo/awesome-2vec

Для неофитов поясняю, мы берём некое пространство, и редуцируем его в пространство меньшей размерности с помощью автоэнекодера прости господи.

В результате получаем семантически сжатое пространство, вектора которого отражают вектора из пространства большей размерности. При том нам становятся доступны такие ништяки как интерполяция, векторные операции и сравнение векторов.

прикольно было бы попробовать редуцировать на другие типы конструкций: алгебры, кольца и т.д.

А с функциями есть что-нибудь такое?

я не эксперт в этих ваших кольцах и гомологиях, но что может быть проще и понятнее обычного вектора ?

У нас есть вектор в n-мерном пространстве. Близкие вектора похожи. Над векторами можно проводить разные операции которые будут интуитивно понятно.

Что предлагает ваш аппарат ?

в векторном пространстве слишком много операций задано. Например, как интерпретировать скалярное произведение двух векторов? Сложение интерпретируется как аналогия. Имхо нужна по настоящему только одна операция, которая должна быть некомутативна (композиция слов) + одна комутативная (аналогия). Идеально для этого подходят кольца:

A ring is a set R equipped with binary operations[1] + and · satisfying the following three sets of axioms, called the ring axioms[2][3][4]

1. R is an abelian group under addition, meaning that

(a + b) + c = a + (b + c) for all a, b, c in R (+ is associative).

a + b = b + a for all a, b in R (+ is commutative).

There is an element 0 in R such that a + 0 = a for all a in R (0 is the additive identity).

For each a in R there exists −a in R such that a + (−a) = 0 (−a is the additive inverse of a).

2. R is a monoid under multiplication, meaning that:

(a ⋅ b) ⋅ c = a ⋅ (b ⋅ c) for all a, b, c in R (⋅ is associative).

There is an element 1 in R such that a ⋅ 1 = a and 1 ⋅ a = a for all a in R (1 is the multiplicative identity).[5]

3. Multiplication is distributive with respect to addition:

a ⋅ (b + c) = (a ⋅ b) + (a ⋅ c) for all a, b, c in R (left distributivity).

(b + c) ⋅ a = (b ⋅ a) + (c ⋅ a) for all a, b, c in R (right distributivity).

точнее варианты колец с измененными пунктами 2 и 3.

как интерпретировать скалярное произведение двух векторов?

Для начала разберёмся с углом между векторами.

Вот у нас есть пространство характеризующее пиструн, пусть это будет длина и ширина. Для каждого пиструна в мире можно задать длину и ширину.

Допустим мы хотим узнать, на сколько похожи два пиструна.

Соотвественно мы можем воспользоваться манхэттенским расстоянием, евклидовым и другими параметрами расстояния минковского.

Померяли расстояние, получилось 15. И что из этого следует ? это много или мало ?

Заменим меру на угол, таким образом получим меру схожести. Если угол 90, то у нас есть два пиструна, один абсолютно толстый, но нисколько не длинный, а другой на оборот. Если угол 0, то мы сможем получить один пиструн умножив характеристики другого на одно число.

В случае множеств я думаю надо смотреть на расстояния Джаккарда.

Например, есть рекуррентная сеть.

Я хочу ее обучать математике, но, как мне дать ей понять, что цифры - это цифры? И что они выражают?

Вместо тупого матана

больной ублюдок, чем тебя обычный калькулятор не устраивает ?

У людей за математикой стоят некие идеи, а математика это просто язык описания этих идей.

Делать математические операции можно и с яблоками не зная вообще ничего о математике.

Если рассматривать математику как часть логики (мы же можем перевести всю математику в бинарное исчисление) то про обычный XOR на ИНС я говорить не буду, скажу что уже есть калькуляторы на нейронках и с недавних пор машины тьюринга.

http://arxiv.org/abs/1511.06279

>>760818

>но как такое реализовать? Может использовать несколько нейросетей? Или есть архитектура сети, умеющая в такое?

>Эта задача НЕ РЕШАЕТСЯ с помощью универсальных аппроксиматоров.

Пиздец, я реально не могу уже с вами. Сколько раз за последние года 3 я упоминал теорему Коско об универсальных нечетких аппроксиматорах - http://sipi.usc.edu/~kosko/FuzzyUniversalApprox.pdf - Аллаху одному ведомо. Вот даже целая книга на эту тему http://gen.lib.rus.ec/book/index.php?md5=BC1EC0F44F2E619AB46D6FD0B7088514 глава 2 особенно, И что? Ответ один - врети, поехавший, и т.д.

>>760819

>в Картах Кохонена вроде реализовано, но они старые.

А, ну ясно. Раз до 2015 года создано, значит старье. А много ли ты слышал о двунаправленных картах Кохонена с супервайзед обучением? https://cran.r-project.org/web/packages/kohonen/index.html Да, карты Кохонена могут в такую задачу, особенно XYF, Supersom и BDK.

>>760830

Идентификация систем же. Маятник или что там у тебя, представляется в виде матрицы Ганкеля и подкладывается нейросети или чему угодно и все, профит. Гугли NARX/NARMAX если интересно подробнее.

>>761134

Входы - любое выражение, выходы - правильные ответы.

>хотел сделать прорыв в науке и изобрести ИИ

>открыл pdf про backpropagation

>не понимаешь линейной алгебры, формул и высшего матана

ладно, пойду дальше круды шлепать.

>работать, как баба маша - затычкой в системе. Короче, всех их заменят скоро роботы и справедливость восторжествует. Вот к чему я,

Считаешь программизм дохуя интеллектуальной работой? Тогда у меня для тебя плохие новости, от бабы маши ты ничем не отличаешься. Ты про конструктивную теорию типов Мартин-Лёфа слышал? Читни http://maxim.livejournal.com/479716.html вот. В крации - любая возможная программа на любом языке программирования есть подмножество инфинити топоса, причем поддается экстракции оттуда.

Вот. Проще уже вряд ли можно найти

http://www.aiportal.ru/articles/neural-networks/back-propagation.html

Интелелктуальный - это вообще избитый термин. Я бы сказал оптимальный, прогрессивный, современный. Один кодер накодит прогу для миллиона роботов, выполняющих функции продаванов. Смотри, какая КПД у кодера и какая у продаванов. У них ведь алгоритм: принять деньги, доставить товар покупателю. Тут даже нейросеть не нужна, этот простой алгоритм уже реализован в автоматах с кофе. Знаешь, мне вот кажется, что это натуральный заговор. да они уже бы смогли поставить везде такие автоматы с роботами (только больших размеров) в каждый магазин, в каждую аптеку, в каждую кафешку и забегаловку. Но нет, они хотят сохранить места для тупого и бесполезного быдла, не могущего в создание чего-то.

а любой натюрморт - это просто набор трехмерных объектов, а теперь попробуй выстроить из рандомных объектов натюрморт, все дело в креативности и организации, которых нет у бидла.

Сразу видно, что по ссылке ты не читал, либо не понял.

Аноны, а почему все только на компьютерах?

Ведь нейронная сеть - это математическая модель.

Но почему она реализовывается только в виде кода? Ведь вычислять и сохранять в памяти умеют и шестереночные механизмы.

Можно ли воссоздать нейронную сеть в виде шестереночного механизма?

А так, как подобные механизмы теперь могут быть ОЧЕНЬ маленькими, то проблем с размерами теперь не будет.

Но в чем будут проблемы? В скорости?

Интересно будет собрать нейронную сеть в аналоговом виде

Да можно вообще делать вычисления с помощью узелков на веревке.....

%%съеби нахуй из раздела??

Можешь почитать про голографические нейросети. Эти поехавшие спят и видят, как они создают AGI на базе голографии. Но на практике там дикий обосрамс.

С чего такая агрессия?

Этого еще никто и никогда не делал же, а у меня внезапно возникла такая мысль.

Не, в голографию не хочу.

А вот сделать что-нибудь забавное на базе шестеренок, игрушку, которая сама сможет чему-нибудь научиться - это забавно.

>Можно ли воссоздать нейронную сеть в виде шестереночного механизма?

Можно. Можно в виде химической реакции, оптических элементов, в виде чего угодно можно.

Обычно все понимают объемные изображения.

>Можно в виде химической реакции

То-есть, теоретически, можно заставить воду в туалете разговаривать с людьми?

Человеческий мозг более чем на 80% та же вода из унитаза. И никаких специальных алгоритмов в мозгу не реализовано, все работает только на свойствах среды. Никого не удивляет при этом, что человека можно научить разговаривать с другими людьми.

Розен, даже не думай.

Представление функции многих аргументов через суперпозиции функций одного аргумента. Колмогоров, Арнольд, Горбань. http://icm.krasn.ru/ftp/articles/1998/2096gorban_SibZhVM98.pdf Это классика, блядь, это знать нада!

Что? А попроще. На примере распознание рукописных цифр. Что эти 15 нейронов делают и почему их количество можно менять? 2 часа назад учить начал

Это самое простое объяснение происходящему, можешь поверить.

На хуй иди. Тебе литературу дали, учи, блять!

Нет, не хочу, говно жрать хочу.

Чтобы получить более высокоуровневое представление

По нейросетям штоле? Вот это можно навернуть, там с примерами http://gen.lib.rus.ec/book/index.php?md5=9EC6CA538388D16910331E309741732E Если сам будешь искать - Хайкина читать не вздумай, вынос мозга гарантирован.

Тебе ж посоветовали >>761451 интересную книжку, там каждый алгоритм на пальцах расписан, кто угодно поймет. Если интересуешься реализацией на практике, вот тебе еще книжка http://gen.lib.rus.ec/book/index.php?md5=A5205BD61ADDC523C7FBFE1D7EB0B3C6

>без понимания сути

Про суть опять же, >>761412 статья. По ссылкам почитай соотв. теоремы Колмогорова и Арнольда. Это именно вся суть происходящего. Вот еще видео есть https://www.youtube.com/watch?v=hc2Zj55j1zU https://www.youtube.com/watch?v=skfNlwEbqck как раз очень годно рассказано и показано распознавание символов.

Ну ты даешь. http://windjview.sourceforge.net/ru/ Впрочем, там есть и пдф http://gen.lib.rus.ec/book/index.php?md5=AE6CE64B978DCC3E4C0623C70D6D5973

Какой-то разваливающийся дед с двумя блоками 60 года выпуска. Поновее ниче нет?

нет там пдф.

Это основы, сначала пойми их, потом гугли поновее.

Поновее в оп-посте ссылка. А этот дед, это не просто дед.

На входе 784 на выходе 10. Да.

Цифры от 0 до 9 же, смотри выход.

расскажи это своему гиппокампу

И вообще, может ли нейронная сеть включать дополнительные слои нейронов?

Может ли ей не хватать нейронов?

Прочитал. Ещё и в гугле определения незнакомым словам искал. А как эти функции, теоремы, радикалы, суперпозиции и прочая хуйня связана с скрытым слоем в той нейросети?

Нейрогенез же.

И то что в скобках тоже не подходит?

Разные, но связанные.

тебе 12? первое имя до запятой идет.

А нужно найти самое популярно женское first name. Пробую так s[s.index('. ')+2:s.index(' ',s.index('. ')+2)]

, но вдруг скобки имеют значение?

Молодец, теперь ты можешь в капитализм.

в третьем классе же одни работяги ехали.

Проиграл с опущенца в видео

Здесь кто-то ещё решал эти задачки? Знает кто ответы и решения на задачи с средним арифметическим возрастов и самым популярным женским именем?

можно ли использовать нейросеть для поиска минимума и максимума?

теоретически скорость работы должна замедлится?

Допустим мне нужно решить FizzBuzz.

Можно ли использовать нейросеть для решения?

Теоретически скорость работы должна замедлиться?

Что ты делаешь то?

НЕЙРОНОЧКИ НЕЙРОНОЧКИ НЕЙРОНОЧКИ

НЕЙРОНОЧКИ НЕЙРОНОЧКИ НЕЙРОНОЧКИ

НЕЙРОНОЧКИ НЕЙРОНОЧКИ НЕЙРОНОЧКИ

НЕЙРОНОЧКИ НЕЙРОНОЧКИ НЕЙРОНОЧКИ

НЕЙРОНОЧКИ НЕЙРОНОЧКИ НЕЙРОНОЧКИ

НЕЙРОНОЧКИ НЕЙРОНОЧКИ НЕЙРОНОЧКИ

НЕЙРОНОЧКИ НЕЙРОНОЧКИ НЕЙРОНОЧКИ

НЕЙРОНОЧКИ НЕЙРОНОЧКИ НЕЙРОНОЧКИ

НЕЙРОНОЧКИ НЕЙРОНОЧКИ НЕЙРОНОЧКИ

НЕЙРОНОЧКИ НЕЙРОНОЧКИ НЕЙРОНОЧКИ

НЕЙРОНОЧКИ НЕЙРОНОЧКИ НЕЙРОНОЧКИ

Быдлецо набигает. Это тленчик.

Тред #2: https://arhivach.org/thread/170611/

НЕЙРОНОЧКИ 101:

1. Introduction to НЕЙРОНОЧКИ, Casella ( http://www-bcf.usc.edu/~gareth/ISL/ISLR Sixth Printing.pdf )

Читается легко, неплохая разминка перед ESL

2. НЕЙРОНОЧКИ and НЕЙРОНОЧКИ, Bishop.

3. НЕЙРОНОЧКИ for Hackers. Введение в НЕЙРОНОЧКИ, годно.

4. http://neuralnetworksanddeeplearning.com

Введение в НЕЙРОНОЧКИ для самых маленьких. Написано простым английским.

5. https://yandexdataschool.ru/edu-process/courses - базовые курсы ШАДа.

НЕЙРОНОЧКИ Advanced

1. Elements of НЕЙРОНОЧКИ (http://statweb.stanford.edu/~tibs/ElemStatLearn/printings/ESLII_print10.pdf )

Сложность - 9 из 10. Шутки в сторону, можно читать годами. Если вы сможете полностью проработать эту книгу и прорешать упражнения, обязательно свяжитесь со мной - у меня найдется работа для вас.

2. Optimization for НЕЙРОНОЧКИ. Edited by Suvrit Sra, Sebastian Nowozin and Stephen J. Wright, MIT Press, 2012.

Иногда from НЕЙРОНОЧКИ.НЕЙРОНОЧКИ import НЕЙРОНОЧКA перестает работать и тогда нужно все переписать. Оптимизация НЕЙРОНОЧКИ на больших объемах данных, НЕЙРОНОЧКИ, НЕЙРОНОЧКИ - вот это все тут есть.

3. http://www.cs.nyu.edu/~mohri/mlbook/

Как ESL, только слегка по-проще. Попробуйте, может зайти.

Дальше вас ждет дикий и необузданный мир. Два маяка https://vk.com/deeplearning и http://deeplearning.net/reading-list/ осветят дорогу: это списки литературы и обзоры статей для прощупывания пульса индустрии.

F.A.Q

По мотивам предыдущего треда.

Эти ваши книжки стоят овер 9000 рублей, как быть?

http://libgen.io

Книги хорошо, но с чего начать практический вкат?

Во-первых, вам нужна любая unix-based система. На Windows возможно запустить нижеперечисленное, но ждите пердолева с настройкой и неодобрительных взглядов анонимуса. Кроме того, в компаниях, так или иначе связанных с разработкой йоба-ПО и НЕЙРОНОЧКEK, Linux/OS X является стандартом. Привыкайте.

Во-вторых, определитесь с языком. Python и C++ наиболее мейнстримовые инструменты, с ними вы без еды не останетесь. Есть еще R, на котором пацаны живут НЕЙРОНОЧКАМИ и анальными пакетами. Некоторые инструменты являются языко-независимыми (Vowpal Vabbit, XGBoost), но обвязывать их вы все равно будете из какой-либо среды.

На Java разработано много production-ready инструментов для бигдаты и если вы угораете по терабайтам данных, то имеет смысл посмотреть в её сторону. Впрочем, лучше это делать уже потом, когда прийдет осознание потребностей.

В-третих, выбирайте себе задачу. Что угодно: распознать качпу, обнаружить ботов по логам, найти раковых больных. Список можно посмотреть, например, на kaggle.com. После чего приступаете к решению выбранной задачи.

Не прийдется ли мне потом с таким наборищем знаний идти в макдак работать?

Несмотря на хайп вокруг НЕЙРОНОЧКИ, далеко не во всех IT компания есть необходимость в НЕЙРОНОЧКИ и понимание круга задач, которые можно решить этими методами. Но поверьте, в 2016 компетентный специалист будет востребован. В России потребителями ваших знаний могут стать: Яндекс, Mail.ru, Вконтакте, Rambler, Касперский, Билайн, Связной, ABBYY, Хуавэй. В биоинформатике есть определенный спрос, можно поскролить http://blastim.ru

Здорово, но я так и не понял чем же вы занимаетесь в IT компаниях?

Попытаюсь ответить со своей колокольни и сразу хочу предупредить, что это едва ли консенсуальное мнение.

НЕЙРОНОЧКИ-специалист - это такое зонтичное определение для человека, способного увидеть проблему, выгрепать кучу логов и данных, посмотреть на них, придумать решение проблемы и врезать это решение его в продакшн. По сути, это кодер, решающий не чисто технические, а, в некотором роде, человеческие проблемы.

Имхо, мы все же остаемся в первую очередь разработчиками.

Но ведь есть НЕЙРОНОЧКИ per se, чем он занимается?

Действительно есть. Одаренная прослойка людей изобретает новые методы, но это правильнее называть просто математикой. Сейчас пищей для ума являются нейронные сети и НЕЙРОНОЧКИ, но даже они двигаются рука об руку с практикой.

Что такое TensorFlow?

TensorFlow - часть гуглового инструмента для перемножения тензоров и оптимизации функционалов. Часть - потому что важные куски типа паралелизации еще не выкачены в паблик. Если вам все ещё непонятно что это, значит это вам и не нужно, сириусли. Google перестарался с рекламой и теперь люди думают, что TF - это серебряная пуля и НЕЙРОНОЧКA для каждой бочки. До TF был Theano, который выполнял свою работу не хуже. И, в отличии от TF, он уже находится в стабильной фазе.

Тред #2: https://arhivach.org/thread/170611/

НЕЙРОНОЧКИ 101:

1. Introduction to НЕЙРОНОЧКИ, Casella ( http://www-bcf.usc.edu/~gareth/ISL/ISLR Sixth Printing.pdf )

Читается легко, неплохая разминка перед ESL

2. НЕЙРОНОЧКИ and НЕЙРОНОЧКИ, Bishop.

3. НЕЙРОНОЧКИ for Hackers. Введение в НЕЙРОНОЧКИ, годно.

4. http://neuralnetworksanddeeplearning.com

Введение в НЕЙРОНОЧКИ для самых маленьких. Написано простым английским.

5. https://yandexdataschool.ru/edu-process/courses - базовые курсы ШАДа.

НЕЙРОНОЧКИ Advanced

1. Elements of НЕЙРОНОЧКИ (http://statweb.stanford.edu/~tibs/ElemStatLearn/printings/ESLII_print10.pdf )

Сложность - 9 из 10. Шутки в сторону, можно читать годами. Если вы сможете полностью проработать эту книгу и прорешать упражнения, обязательно свяжитесь со мной - у меня найдется работа для вас.

2. Optimization for НЕЙРОНОЧКИ. Edited by Suvrit Sra, Sebastian Nowozin and Stephen J. Wright, MIT Press, 2012.

Иногда from НЕЙРОНОЧКИ.НЕЙРОНОЧКИ import НЕЙРОНОЧКA перестает работать и тогда нужно все переписать. Оптимизация НЕЙРОНОЧКИ на больших объемах данных, НЕЙРОНОЧКИ, НЕЙРОНОЧКИ - вот это все тут есть.

3. http://www.cs.nyu.edu/~mohri/mlbook/

Как ESL, только слегка по-проще. Попробуйте, может зайти.

Дальше вас ждет дикий и необузданный мир. Два маяка https://vk.com/deeplearning и http://deeplearning.net/reading-list/ осветят дорогу: это списки литературы и обзоры статей для прощупывания пульса индустрии.

F.A.Q

По мотивам предыдущего треда.

Эти ваши книжки стоят овер 9000 рублей, как быть?

http://libgen.io

Книги хорошо, но с чего начать практический вкат?

Во-первых, вам нужна любая unix-based система. На Windows возможно запустить нижеперечисленное, но ждите пердолева с настройкой и неодобрительных взглядов анонимуса. Кроме того, в компаниях, так или иначе связанных с разработкой йоба-ПО и НЕЙРОНОЧКEK, Linux/OS X является стандартом. Привыкайте.

Во-вторых, определитесь с языком. Python и C++ наиболее мейнстримовые инструменты, с ними вы без еды не останетесь. Есть еще R, на котором пацаны живут НЕЙРОНОЧКАМИ и анальными пакетами. Некоторые инструменты являются языко-независимыми (Vowpal Vabbit, XGBoost), но обвязывать их вы все равно будете из какой-либо среды.

На Java разработано много production-ready инструментов для бигдаты и если вы угораете по терабайтам данных, то имеет смысл посмотреть в её сторону. Впрочем, лучше это делать уже потом, когда прийдет осознание потребностей.

В-третих, выбирайте себе задачу. Что угодно: распознать качпу, обнаружить ботов по логам, найти раковых больных. Список можно посмотреть, например, на kaggle.com. После чего приступаете к решению выбранной задачи.

Не прийдется ли мне потом с таким наборищем знаний идти в макдак работать?

Несмотря на хайп вокруг НЕЙРОНОЧКИ, далеко не во всех IT компания есть необходимость в НЕЙРОНОЧКИ и понимание круга задач, которые можно решить этими методами. Но поверьте, в 2016 компетентный специалист будет востребован. В России потребителями ваших знаний могут стать: Яндекс, Mail.ru, Вконтакте, Rambler, Касперский, Билайн, Связной, ABBYY, Хуавэй. В биоинформатике есть определенный спрос, можно поскролить http://blastim.ru

Здорово, но я так и не понял чем же вы занимаетесь в IT компаниях?

Попытаюсь ответить со своей колокольни и сразу хочу предупредить, что это едва ли консенсуальное мнение.

НЕЙРОНОЧКИ-специалист - это такое зонтичное определение для человека, способного увидеть проблему, выгрепать кучу логов и данных, посмотреть на них, придумать решение проблемы и врезать это решение его в продакшн. По сути, это кодер, решающий не чисто технические, а, в некотором роде, человеческие проблемы.

Имхо, мы все же остаемся в первую очередь разработчиками.

Но ведь есть НЕЙРОНОЧКИ per se, чем он занимается?

Действительно есть. Одаренная прослойка людей изобретает новые методы, но это правильнее называть просто математикой. Сейчас пищей для ума являются нейронные сети и НЕЙРОНОЧКИ, но даже они двигаются рука об руку с практикой.

Что такое TensorFlow?

TensorFlow - часть гуглового инструмента для перемножения тензоров и оптимизации функционалов. Часть - потому что важные куски типа паралелизации еще не выкачены в паблик. Если вам все ещё непонятно что это, значит это вам и не нужно, сириусли. Google перестарался с рекламой и теперь люди думают, что TF - это серебряная пуля и НЕЙРОНОЧКA для каждой бочки. До TF был Theano, который выполнял свою работу не хуже. И, в отличии от TF, он уже находится в стабильной фазе.

Э, слы, пацан, у тебя в нейроночке LSTM юниты есть? А если найду?

Объясните, пожалуйста, зелёному студенту, почему из этого:

>>любая возможная программа на любом языке программирования есть подмножество инфинити топоса, причем поддается экстракции оттуда.

следует, что

>>программизм не является дохуя интеллектуальной работой

?

Топос — тип категорий в теории категорий, по своим свойствам напоминающих и обобщающих категорию множеств. То есть выше утверждается,что любую программу можно формализовать, упростить и как следствие, автоматизировать?

Это маняфантазии технофашистов. Любой текст на естественном языке тоже внезапно объект Set, и эти кукареки ничем не лучше утверждения о том, что Шекспир это обезьяна, которой дали перо и чернила.

Тогда и механизм работы человека тривиальная программа.

Меня эти топосы уже просто доебали, не могу их слушать, одно кольцо охуительней другого.

>>762658

Спасибо.

А то я за это время подумал и уже было пришёл к согласию с тем, что, по аналогии с текстом произведений Шекспира, который

>>на естественном языке тоже внезапно объект Set ,

текст программы, безусловно является тривиальным, но зато процесс поиска идеи и разработки в обоих примерах считается выдающимся, потому что пока что недостаточно изучен. В общем, загнался.

Прочитал, но не нашёл ни слова про интеллект. Причина того, что, по мнению >>761201 , программистов рано или поздно заменят роботами, понятна без ссылки. Не понятно высказывание про интеллект. По-моему, дело в том, что слово выбрано неверно, как выше уже писалось. Только сейчас до этого >>761264 дошёл.

Вот обновлённая статья с подробностями и красивыми графиками: http://j-asymmetry.com/Koleshko_3_2015.pdf.

Цитаты:

>>"Полный разум — это гипер-метаэвристическая многокомпонентная гиперсферная интеллектуальная нейронная сеть (МГИНС) с логическим и интуитивным ускоренным распознаванием сенсорных информационных образов, беспроводных сенсорных систем и сетей при классической метрологии.

>><...> Ряд электронных блоков выполняют функции левого полушария, то есть самоорганизующегося гиперметаэвристического распознавания информационных образов, и правого полушария, то есть интуитивного прогнозирования на основе ранее полученных знаний. Чтобы придать сенсорам разум, на основе самоорганизующейся МГИНС проводится обучение на количественных данных информационных сенсорных образов."

Меня напрягает указание "Европейского свободного смарт университета удаленного доступа", информации о котором нет в интернете.

Пробую model.__class__, выдает

<class 'sklearn.linear_model.logistic.LogisticRegression'>

а мне нужно только 'LogisticRegression'

>>>"Полный разум — это гипер-метаэвристическая многокомпонентная гиперсферная интеллектуальная нейронная сеть (МГИНС) с логическим и интуитивным ускоренным распознаванием сенсорных информационных образов, беспроводных сенсорных систем и сетей при классической метрологии.

Хуета и вода, итак понятная каждому дауну.

>Ряд электронных блоков выполняют функции левого полушария, то есть самоорганизующегося гиперметаэвристического распознавания информационных образов, и правого полушария, то есть интуитивного прогнозирования на основе ранее полученных знаний. Чтобы придать сенсорам разум, на основе самоорганизующейся МГИНС проводится обучение на количественных данных информационных сенсорных образов."

Ну, вопросы на счет самоорганизующегося

Интуитивного прогнозирования - обычное прогнозирование, никакой интуиции в этом нету.

Придать сенсорам разум, лел

Ога, сначала учим, потом она распознает, ничего в точности не указано, вода.

Итого: статья дерьмо.

>Полный разум — это гипер-метаэвристическая многокомпонентная гиперсферная интеллектуальная нейронная сеть (МГИНС)

Уже на этом этапе фрикометр зашкалило.

Вот на хабре было пиздато написано про ассоциативную работу нейронов.

А про все остальное? Логические решения, например, удаление информации и прочее?

Авторитет информации и то, как человек создает контекст - тоже очень интересно.

Самый прикол, что в статье описан обычный перцептрончик, к которому добавлены какие-то эвристики. Ну и всю терминологию переписали на какую-то шизу типа мегагитлерметаэвристический технослой технодендрит и т.п. Наркоманы какие-то.

Обычный перцептрончик

А будущее то, будущее то, за рекуррентными нейронными сетями.

Но это когда они научатся анализировать всю прошлую информацию, а не просто учитывать ее подольше перцптрончика.

Вот ты неправ. Это как раз путь в никуда, уже сейчас все эти глубокие сеточки сходятся неделями на GPU-кластерах, все закончится на том, что дойдут до сеточек, которые даже на Аллахе не сойдутся за приемлемое время.

Это да, недавно на тире тестировалась модель рекурретной сети.

У нас была информация о массе заряда, его скорости и положению ружья Оно стояла на одном расстоянии от мишени

Ее фича в том, что всю информацию, которая она запоминает влетает в банку памяти и оттуда в БД.

Информация бралась из БД и отдельно обсчитывалась сетью, которая была обучена математическим операторам и понятию ряда, пропорции.

На удивление, она быстро научилась считать то, куда попадет.

Но вот ресурсов поела сильно.

Ну, на самом деле не так уж много она и пожрала, просто провела овердохуя вычислений, считайте, что обсчитала вообще всю информацию.

На 1 выстрел она перемножила, переделила, вычитала и складывала все, определила то, что там больше и меньше чего.

На 2 выстрел она уже проводила математические действия с 2-мя таблицами.

На 3 выстрел она уже нашла закономерность и 4 выстрел смогла предсказать.

Теперь интересно бы было, если она научилась бы находить закономерности между 2-мя действиями, если, например, изменить ружье, а потом, снова его взять, или что будет, если в действие вступит аэродинамика на дальних расстояниях, как она будет формировать исключения.

Эх, а потом на шагоход.

Зачем для этого рекуррентная нейросеть, поясни. Типичная задача векторного квантования, т.к.:

>информация о массе заряда, его скорости и положению ружья

-это вещественнозначный вектор.

Потому что надо, чтобы сеть из знаний о своем нихуя взяла и сформировала методы по быстрому.

>>763043

Ну так я об этом. обучение без учителя.

То есть эта схема уже устарела или она изначально была бредовой?

>>763033

Ого. Где это тестировалось?

Никто еще не сделал такую программу %%хотя заготовки уже есть и многие сайты можно

А в связи с развитием технологий многие фреймворки и прочая лабуда устаревает.

>нечеткая логика здесь уже не справится

Это еще почему? С шагоходом вполне возможно построить полную базу правил, которая будет охватывать все возможные положения ног и нарушения равновесия для их компенсации. Априорные формулы для этого не нужны.

Заебешься все это строить, очень заебешься.

Да даже тогда он будет ходить как парализованный инвалид.

Мы проверяли, поверь.

А нейронная сеть в этом плане выгоднее ген. алгоритма, так как научиться ходить может всего за 10 шагов от учителя.

Но для этого ее надо немного допилить.

Но есть страх в том, что робот сможет ошибиться и не поймет, в чем именно.

Прямо как человек, лал.

>На кафедре Информационных технологий.

Пожалуйста, напиши название института. Иду в магистратуру по этому направлению, очень бы пригодилось.

Тир говоришь? А сколько у вас всего параметров то было? Скорость, масса, положение и цель?

Да там же не так уж и много вариантов перебора?

Да, а кроме этого еще и наклон оружия, изначально оно стояла под 90 градусов.

У всех тех переменных по 20 значений.

И меня возмутило то, что нейронные сети вообще сравнивают с человеческим мозгом.

Они, пусть и симулируют часть его работы, но уже давно ушли от той математической модели, что есть в голове у животных и людей.

То, чем руководствуются живые существа - это больше нечеткая логика и работала сигналов-транспортных путей, чем нейронные сети.

Что почитать о работе мозга порекомендуешь? Не столько для проф пользования, я даже не совался еще в мл и все такое, сколько для общего образования

Для общего образования. Знать как работает твоя память мне кажется полезнее чем не знать.

Ты оттуда ничего не поймешь же, там не написано в точности, как работает твоя память, ибо это слишком общее описание.

Да и вообще, за такими вопросами тебе в когнитивную психологию.

Ок, спасибо. Говна тебе.

сравнивают их только две категории:

1. долбоебы журналисты, которые нихуя не шарят

2. ученые которые дохуя шарят но их сравнения очень точные и в узком смысле (типа корреляции активаций конвнетов и нескольких слоев сетчатки)

не слушай первых, а про вторых ты скорее всего ничего не знаешь.

>Они, пусть и симулируют часть его работы, но уже давно ушли от той математической модели, что есть в голове у животных и людей.

А у тебя когда самолеты птичками называют не бомбит случайно? На самом деле ушли не далеко, просто реализуют те же идее на другой "элементной базе".

Я уже давно не встречал таких сравнений.

>меня возмутило то, что нейронные сети вообще сравнивают с человеческим мозгом.

Как из душа окатило, аж трисёт? Про любые нейросети, которые сравнивают с человеческим мозгом, обычно пишут что там именно от биологических нейронов, какой функционал эмулируется и т.д. Ну если это серьезная работа, а не быдлостатейка. Более предметно - 2 и 4 главы https://rutracker.org/forum/viewtopic.php?t=5096476 этой книжки. Можешь читнуть и сказать, возмутило ли тебя там что-нибудь.

>То, чем руководствуются живые существа - это больше нечеткая логика

Любая адаптивная нечеткая модель это частный случай нейросети, т.к. свободные параметры надо как-то настраивать, а самый естественный способ это сделать - то же самое обратное распространение ошибки.

бигдата и пр. в сбербанке - заебись!

Почему нет хайпа вокруг карт Кохонена, а все вокруг дрочат на AE, VAE, RBM, DBM?

а капчу гугл чем распознавать?

Шизопдф не читай,

@

Ебанутый вопрос сразу задавай

Тут господа-академики беседают за МЛ, а не за вебпараши

Что ты забыл на сосаче, академик? иди свои диссертации пописывай.

>Почему нет хайпа вокруг карт Кохонена

Форсить некому. Это касается не только SOM, а вообще всего адаптивного векторного квантования - LVQ, Neural gas, Growing neural gas.

>>764747

>Потому что они deep.

Не поэтому. Некие японцы разрабатывали стеки из SOM (SOM^2, SOM of SOMs и т.д.) не зашло, опять же из-за малоизвестности.

Каким боком он нужен?

Попробуй сделать манипулятор хотя-бы на нейронных сетях и узнаешь, каким боком он нужен

Потому что никто не развивает, а тащить на себе это - вообще не хочется.

Да и нахуй оно нужно? Что-то я еще здравого применения не видел.

>>764804

>никто не развивает

https://github.com/peterwittek/somoclu

Somoclu is a massively parallel implementation of self-organizing maps. It exploits multicore CPUs, it is able to rely on MPI for distributing the workload in a cluster, and it can be accelerated by CUDA.

>я еще здравого применения не видел.

http://gen.lib.rus.ec/book/index.php?md5=259CC290B1BD9BDFF950EB595C1CB0E9

http://scanlibs.com/postroenie-sistem-mashinnogo-obucheniya-na-yazyike-python/

Аноны, годнота или нет? Добавите в шапку для начинающих?

Короч взял готовую реализацию сверточной сети на теано, она там на мнисте обучается. Сделал под свои 32 на 32 генерированные цифры с помощью пхп скрипта переделал, а она хуй че обучается.пиздец короч

Кто не знаком, вкратце:

1) Пошаговая карточная игра для 2-х игроков

2) Колода оппонента не известна и состоит из 30 карт (из 1000+), но какие-то карты имеют бОльшую вероятность там оказаться (некоторые почти 100%-ую)

3) В среднем матч длится 15 ходов, на каждом ходу у игрока примерно 3-15 вариантов действий, некоторые действия приводят к разному исходу (эффект рандома)

По идее мы тут ближе к го, чем к шахматам.

Есть ли смысл вкатываться в ML или лучше использовать минимакс и эвристику?

В публичном доступе точно нету.

Матчхистори официально не поддерживается, есть только самодельные решения для трекинга.

Даже если насобирать сколько-то, часто выходят обновления (карты меняются, добавляются новые). Еще осложняется тем, что может быть очень много разных колод.

Я так понимаю, в лучшем случае получилось бы обучить какую-то конкретую колоду против другой конкретной.

Херово, с ангельским у меня проблемки, а тут вроде бы все годно расписано. Есть ли русскоязычное подобие, которое не обосрали? Конкретно интересует Байес и бинарная классификация с помощью scikit. А везде просто формулы и код, поясняют его не так годно, как в книжке.

Или я неправ и скорее всего изменю свое мнение почитав литературу об ИИ?

Ты на вопрос ответь, плиз, если можешь, то что я нулевый и мне много читать надо я сам понимаю.

А ответ мне важен потому что я свое восприятие изучаю. Это важно для саморазвития.

"Интеллект" - это просто термин, к тому же неформализованный. Рандомная гуманитарщина, короче. Без сколько-либо строгих определений говорить об эквивалентности чего-то одного чему-то другому бессмысленно.

Ясно, спасибо большое.

Интеллекта у человека нету?

Как разгадаем полностью работу мозга - так можно будет о чем-то подобном говорить.

А создание ИИ - и правда вопрос ресурсоемкости, но это не триллиарды условий если.

>Интеллекта у человека нету?

Ну как мы выяснили туманное понятие. Самая суть моей точки зрения, это что нет никакого трудного и магического порога в достижении ИИ равного человеческому нет и он будет достигнут просто увеличивающейся сложностью.

На самом деле нет.

А трудный и магический порог в достижении хоть немного работающей системы есть.

Не то, чтобы она была равной человеческой

Обосрался ты, братюнь. Это тебе нужно несколько лет, чтобы научиться управлять пикрелейтедом как автоматика, и то будешь дергать джойстик как эпилептик, а контроллер за 1 сек прошивается. Не говоря о том, что у тебя реакция раз в 100 хуже, чем у автоматики и от атаки ты не увернешься, причем так чтобы не уебаться. То же самое с игорами, против нормального алгоритма без искусственных ограничений ни тебе ни кому другому не устоять. А "интеллект" и прочая фуфлософия это просто слова.

> Сёрл.тхт

> Artificial general intelligence (AGI) is the intelligence of a (hypothetical) machine that could successfully perform any intellectual task that a human being can.

>the intelligence that could perform any intellectual task

Люблю такие определения. Не мешало бы еще тогда определить понятие intellectual task.

intellectual task is a task that requires intelligence to solve

оказалось че ЧБ изображения не конвертирует в нумпи аррай нормально.

>но при этом она бесконечно далека от понимания того, что на самом деле происходит: что это игра, что игра это модель реальности, что определенные картинки символизируют свои ИРЛ аналоги.

Нет, все зависит от обучающей выборки и того, сколько ты ей данных подаешь, если она не может анализировать остальной мир, то на что ты вообще надеешься?

Полноценный искусственный человек не нужен.

И сверточными сетями?

Совсем не понимаю, в каждом слое нейронов они растаскиваются, как в картах?

>Есть средства для решения каких-то формализованных задач

>>765648

>никто понятия не имеет, как сделать

>>765775

Поноценный "человек" в машине это как раз то, что нужно, в этом и есть "порог". Программа, распознающая картинки, это просто игрушка или в лучшем случае некий инструмент, но к самому понятию интеллекта оно даже близко не стоит, потому что она не понимает, что это за картинки, зачем их нужно распознавать.

Пример с понгом был просто для пояснения. Суть в том, что даже если ты подашь как обучающую выборку, скажем, несколько лет записей теннисных турниров, миллиарды часов симулированных прыгающих мячиков, или что угодно из этой области, оно все равно не научится сопоставлять это с тем, что происходит в понге. Оно не поймет в чем суть игры, что второй ракеткой управляет условный противник, что цель игры в ловле мячика, что надо отразить мяч по определенной траектории чтобы противник его не поймал. Ведь в этом суть понга, а не в том, что если пиксель 57:134 ярче 0.3, то нужно подать 0.8 на выход 3, т.к. раньше в миллионах предыдущих эпизодов такое действие приводило к большей награде в 50.02% случаев.

Бля, 30+ лет прошло, а эти дебилы всё ещё мусолят Сёрла в комнате. Съеби отсюда со своим пониманием, квалиа и рефлексией.

Ничего никуда не растаскивается. Ни в мозгу, ни в картах Кохонена.

>>766340

Читай про физиологические модели SOM. Что такое "волновая модель мозга" я не знаю.

Да я понял.

Но мне интересно, а как тогда в мозгу, в случае ошибки, мы запоминаем то, что предыдущий опыт был неверен?

Получается, что сеть запоминает предыдущее состояние или что?

Если у меня например карта организовалась, но тут оказывается, что данные прежние неверные и мне надо запомнить исключения.

Чтобы было, как у человека в голове.

Как мне поступить?

Может запоминать ошибки отдельно в память?

Анон, нет, я уже второй день ищу инфу по поводу того, как гормоны воздействуют на нейроны.

Нет, вот нейроны просчитывают и обрабатывают информацию, по сути - они сумматоры, а нейронная сеть просто аппроксиматор

КАК НА ЭТО ДЕЙСТВУЮТ ГОРМОНЫ? Нигде не нашел подобной инфы, придерживаюсь волновой модели мозга.

>ищу инфу по поводу того, как гормоны воздействуют на нейроны.

На русском языке поди ищешь? Неудивительно. Родина дала сайнсдирект http://www.sciencedirect.com/ ищещь там по ключевым словам, затем релевантные статьи пиздишь через сайхаб. Вот эту книжку еще посмотри http://gen.lib.rus.ec/book/index.php?md5=FB94D5F7C1F4A86F7C1EAAD002A711AB

Если использовать несколько SOM и попытаться "накладывать" их друг на друга, то можно получить интересный результат.

Мне кажется, что сеть начинает уметь в "абстракцию".

Мы продолжили обучать сеть на том, чтобы она на этот раз попробовала в управление шагоходом.

И получилось, что у нее очень хорошо выходит обобщение.

Сеть сама смогла понять, что от нее имеют ввиду, когда просят пойти вправо или влево, сама классифицировала и выдала нам все значения.

То есть она уже работает не просто со значениями, она их классифицировала и выделила закономерности, обобщив все.

И самое главное то, что она может делать то, что не смогла раньше, теперь она подбирает направление конечностей не единообразно, а ищет лучший вариант, разрабатывая стратегию самостоятельно.

Я уже не первый раз тута пишу, что многие задачи, которыми содомируют всякие модные глубокие сети и прочий градиентный бустинг, тривиально сводятся к адаптивному векторному квантованию, в частности SOM. Я тебе больше скажу - в твоем случае и карты Кохонена излишни, т.к. они нужны для проецирования многомерных данных на 2д вид. В случае шагохода это абсолютно лишняя работа, более чем достаточно было бы использование "нейронного газа" NG или его растущей разновидности GNG. И да, все эти алгоритмы можно стыковать через опорные векторы для получения глубоких сетей, такие стеки очень даже могут в абстракцию в т.ч. для динамических систем и т.п. В т.ч. и буквально, есть примеры использования карт Кохонена для анализа текстов и их классификации по семантике. Н-р WEBSOM. Растуще-иерархические карты Кохонена GHSOM для этого еще лучше. Вот эти ребята http://www.ifs.tuwien.ac.at/dm/somtoolbox/ этим занимались. У них же есть примеры классификации музыки по жанрам и рекомендации музыки, похожей на понравившуюся с помощью SOM.

Да это вообще новая информация для меня оказалась.

В частности то, что сеть учится выбирать стратегии, если раньше она видела только поля значений и логику в виде взаимодействий, то теперь она все это классифицировала и использует как абстрактное понятие.

Если раньше был манипулятор с 4 степенями свободы, который умел двигаться по кругу и хватать предметы, то теперь он научится делать это с разворота и двигать конечность нестандартно.

А вот GHSOM - очень интересная сеть, надо посмотреть.

https://www.crcpress.com/Music-Data-Mining/Li-Ogihara-Tzanetakis/p/book/9781439835524

Если тi хочеш уяснить как поет Мiку Хатсуне, тобi сюда:

http://www.dmoz.org/Arts/Music/Theory/Tuning_Systems/Microtonal/

Или она настолько прочно завязана с математикой, что у нее сомнений не возникает?

мимопроходил

>А вот GHSOM - очень интересная сеть, надо посмотреть.

http://www.ifs.tuwien.ac.at/~andi/ghsom/publications.html Тут статьи по GHSOM. В этом алгоритме самое интересное то, что он не затрагивает самой SOM, а реализован как бы поверх нее и работает за счет манипуляций с ошибкой квантования. Т.е. при желании нечто похожее можно прикрутить к любому алгоритму векторного квантования, технических проблем нет. Если бы я не был хуем, не могущем в серьезное программирование, обязательно занялся бы этой темой, благо идей хватает.

>>767879

>может ли нейронная сеть сомневаться?

Может. Считай вероятность классификации нейросетью обратно пропорциональной сомнению. То же с нечеткостью для нечетких моделей. В конце-концов человеческое сомнение возможно только там где есть неточность. А неточность это либо вероятность, либо нечеткость события и т.д.

Или она настолько прочно завязана с математикой, что у нее любви не возникает?

мимопроходил

Аноны, а могут ли люди влюбляться?

Или они настолько прочно завязаны с химией, что у них любви не возникает?

Насколько я понимаю, для этой задачи нужна обратная связь, чтобы сеть могла планировать свои ходы, но как такую обучать - не представляю.

Какие сети там используются? Какая у неё структура?

У меня довольно поверхностные знания в этой области, поэтому слабо представляю, как с помощью сетей решать более сложные задачи, чем распознавание циферок на поле 8x4.

>А можно ли нейросеть научить играть в карты? В дурака, скажем?

Легко, в шахматы может.

В Го может.

Обычный перцептрон даже сможет.

Задача из теории вероятностей, не более, ходов не так уж и много.

С одним семеном-хейтером нейросетей на самоподдуве?

>>767991

Забудьте вы слово "нейросеть" вообще, это просто аппроксиматор функций. Если задачу можно представить в виде переменных с какой-либо (даже априорно неизвестной) взаимосвязью между ними, значит нейросеть в это может.

Ты кого петухом назвал, сука?

Нет, погугли, как учат в шахматы играть.

А я пока набью ебало тому петуху, который не любит нечеткую логику

>автоэнкодер

это когда пропустили сигнал через сеть, а потом хуяк и пропустили в обратном направлении с тем же сигналом и весами который был на выходе.

5 лет в ДМ, статьи, публикации, магистратура. Не сказать, что пиздец продуман, но не новичок.

Работы нет, сижу во всяких шарашках делаю хуй пойми что.

Думаю зря я этим занялся. На каггле пиздец, лютые типы через час после начала грузят под максимум - ловить нехуй.

В яндексе и в мейле уже сидят люди. Биоинформатика в России это пиздец уровня мытья толчков по выходным.

Так что не идите сюда, в натуре пацаны, я не шучу, если не хотите жестко проебаться.

Сам не подскажет, нужно свистопердюли поверх строить вроде.

блять, это вопрос уровня детсадовца. не думаю, что даже у школьника хватило тупости такое спросить.

В начале января модераторы онлайн-игры EyeWire, посвященной картографированию сетчатки человека с обозначением всех находящихся там нейронов и связей между ними (синапсов) силами добровольцев со всего мира, с гордостью заявили о завершении обследования 250-го нейрона. Учитывая, что таких нейронов в сетчатке больше миллиона, это достижение трудно назвать гигантским прорывом — скорее один из первых шажков по дороге «в тысячу ли». Дороге, которая должна привести нас к раскрытию тайн нашего мозга. И кто знает — может быть, даже к цифровому бессмертию.

Тогда будущий Нобелевский лауреат 2002 года Сидней Бреннер (Sidney Brenner), южно-африканский биолог, предположил, что поведение живого организма можно понять, составив полную карту его нервной системы. Он взялся за простейшую нервную систему круглого червя Caenorhabditis elegans (всего 302 нейрона, распределенных по всему телу), и, изучая один за другим его тонкие срезы, создал за два десятилетия полную нейронную карту. В 1986 году она была опубликована в Philosophical Transactions of the Royal Society of London, почтенном научном журнале, основанном еще Исааком Ньютоном. Номер вышел объемным, в 340 страниц, и с тех пор многие биологи называют его Книгой, причем не столько из-за фолиантной толщины, сколько из-за информации, которая там содержится, и сегодня, спустя почти три десятилетия, остается для исследователей сборником вопросов без ответа.

Пиздос 304 нейрона управляют червем. Как же такое на кампутерах не повторить-то?

Довольно хуево гуглится. Везде сплошной научпоп о невероятном прорыве нейросетей с весьма поверхностным обзором. Исходники ёбаные 30к крестодрисни не слишком хочется читать.

Может, сам на пальцах пояснишь, какую архитектуру сети он там использует или какую ты бы использовал?

Почта randomma5M9il1ANUSGCKbkPUNCTUMr.1hu

Да, я использовал две сети SOM для того, чтобы сеть могла абстрагировать данные, это вполне подобно тому, как человек это делает.

Но что получается, когда нам нужно классифицировать больше признаков и их количество нам неизвестно?

Также интересна еще следующая вещь, в мозгу человека многие отделы мозга общаются с друг-другом только для того, чтобы узнать о происходящем и на основе своей "логики" что-либо предпринять.

Нам требуется нечто подобное, дабы каждая конечность могла обучаться в процессе более эффективнее, чем сейчас.

Кстати, внезапно, но обнаружил, что игровые движки с физикой Rigdoll вполне могут что-нибудь классное симулировать.

> я возвращаюсь к задачам классифицирования.

таак..

> ... НЕЙРОНОЧКИ ИИ НЕЙРОНОЧКИ КОКОК

понятно

>что получается, когда нам нужно классифицировать больше признаков и их количество нам неизвестно?

Я ж говорю - любое unsupervised адаптивное векторное квантование (NG/GNG). SOM это несколько не то что нужно в данном случае, оно для визуализации и визуального анализа данных. В случае надобности все это легко визуализируется, например проекцией Сэммона, для наглядности можно даже мозаику Вороного прикрутить.

>These early attempts of simulation have been criticized for not being biologically realistic. Although we have the complete structural connectome, we do not know the synaptic weights at each of the known synapses. We do not even know whether the synapses are inhibitory or excitatory. To compensate for this the Hiroshima group used machine learning to find some weights of the synapses which would generate the desired behaviour. It is therefore no surprise that the model displayed the behaviour, and it may not represent true understanding of the system.

Очевидный дата майнинг.

Вот я дурааааак. Оказывается слой свертки - просто максимум из 4-ех значений(если 22), а я думал настраиваемые веса 22 и настраивал их.

>максимум из 4-ех значений

Максимум - это max pooling. Свертка - это умножение значений исходных пикселей на значение ядра свертки.

Да, имелось ввиду объединение. Это единственное место где нет весов.

И да, картинка неправильная, -8 должна быть в самом левом верхнем углу.

Что тебе понятно?

Да нет, SOM - это конкретно то, что нужно в данном случае.

А векторное квантование и тут и там присутствует.

Да и гугл что-то отказывает гуглить NG сети.

Аноны, хочу вкурить, что такое персептрон

Рекуррентные сети и этот ваш SOM

Уже завтра начну повторять Питона.

А что по сетям почитать?

Не на английском, я то перевести смогу, но хуево.

Японский, лол.

У меня, допустим, есть потребность в динамической памяти, которую нужно по разному обрабатывать и сохранять, причем, эта информация всегда остается актуальной.

а если упростить с несущественными потерями, то мы получим искусственную нейросеть с полезной структурой, которую можно было бы применить где-либо.

Нейронную сеть и так можно применять где-либо, а по сути - везде.

Но суть далеко не в этом.

Суть в том, что приходится пилить ОЧЕНЬ МНОГО КОСТЫЛЕЙ.

Знаете, что пришло в голову в нашем универе у людей? А давайте обучим сеть чистой мат логике и на основе иерархической структуры будем анализировать вообще все.

То-есть хотят взять числа и прочие показатели как константу, связать их с методами и обрабатывать.

Это пиздецкие костыли, а ведь я просто предлагал использовать классификацию для того, чтобы получать новые методы..

>гугл что-то отказывает гуглить NG сети.

Neural Gas / Growing Neural Gas.

>>771132

А с чего ты вообще взял, что различные (адекватные решаемой задаче) представления данных это костыли? Чтобы решить какую-то задачу каким-то аогоритмом, ее нужно представить в виде, адекватном для алгоритма, это норма. В чем костыльность-то?

Это представьте, что если бы вы для решения примера вспоминали бы всю математику заново и вспоминали бы все свои ранее решенные примеры ради чего-нибудь простого.

Нет, с 2 + 2 это еще легко, но на практике понадобится пиздецкая мощность для 50 параллельных расчетов одновременно.

Правда такая сеть может считать вообще все, что угодно, подходит для решения любой задачи, где есть набор переменных и надо найти взаимосвязи

И чем сложнее задача и больше переменных, тем больше придется просчитывать, в некоторы случаях нужно около 10000 вычислений одновременно.

Ну, можно еще сократить вычисления до 100, но тогда обучение будет очень медленным и ответа придется ждать долго.

>>771157

Я так и не понял, в чем проблема. Долго? Так новомодные сверточные сети на многопроцессорных теслах по месяцу сходятся, и всем норм.

Я бугурчу от отсутствия иерархичности и рационального подхода, все тупо сваливают в одну кучу, пишут говнокод

Или где почитать в целом об работе одного, конкретного, отдельного нейрона

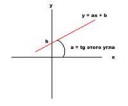

Коэффициенты линейной функции ax+b, где x - вход, a - "синаптический" вес, b - порог.

>где почитать в целом об работе одного, конкретного, отдельного нейрона

Да где угодно, на каждом углу жи расписано.

А что делает конкретно, один нейрон в сети?

Тупо складывает поступающие на него значения или что?

И чему равен этот синаптический вес?

>что делает конкретно, один нейрон в сети?

Если речь о перцептроне, то вычисляет суперпозицию частной функции от одного аргумента в общей функции от многих аргументов. Горбаня читни http://www.pereplet.ru/nauka/Soros/pdf/9812_105.pdf http://kpfu.ru/portal/docs/F1732864826/02_5.PDF у него годно расписано что и зачем. В общем случае - постарайся понять что такое линейная функция, в той же педивикии есть. Как она соотносится с "нейроном" - я написал. Для чего нужна функция активации нейрона (обычно нелинейная, н-р сигмоид) на пальцах объяснить уже сложнее, там суть в том, чтобы деформировать входы так, чтобы они оказались линейно-разделимыми для линейных функций первой части "нейрона". Общая же суть происходящего - аппроксимация зависимости выходов от входов.

>>771211

Этот прав, тебе в матан надо.

Сначала пойми что такое функция вообще

Потом, все про линейные функции.

Пойми про суперпозицию функции.

И это будет только началом, но не согласен с тем аноном по части матана, не нужно его столько, вон, есть статьи попроще на хабре

https://geektimes.ru/post/84125/

https://habrahabr.ru/post/143129/

Да и вообще, представлять все в виде сети Джордана и пытаться применить к банкам памяти метод векторного квантования - малясь долбоебизм.

Это разные алгоритмы, от слова совсем разные. Гугли каждый.

>как выбрать нужный алгоритм, исходя из данных?

Тут два варианта:

- читаешь про каждый алгоритм, понимаешь его логику (что, как и с какой целью он делает), думаешь что лучше подойдет для решения конкретной задачи, анализа конкретных данных.

- хуяришь все подряд, прямо по списку, смотришь с каким алгоритмом самый лучший результат (при классификации - наименьшее количество неправильно классифицированных примеров из тестовой выборки).

Спасибо, так матан совсем легкий.

Получается, что посылаются векторы, адаптивный сумматор их считает посылает на нелинейный преобразователь сигнала и тот преобразует в число, потом этот сигнал перераспределяется на выходе.

Это пока просто.

Но тут в дело входит просто охуительное объяснение, спасибо блядь, что из этого понятно вообще?

>Линейная связь – синапс отдельно от сумматоров не встречается, однако для некоторых рассуждений ывает удобно выделить этот элемент. Он умножает входной сигнал x на “вес синапса” α.

Как, зачем и нахуя задавать этот вес синапса? По какой логике и чему он должен быть равен?

>потом этот сигнал перераспределяется на выходе.

На выходе полученное значение сравнивается с реальным, разница (ошибка) используется для настройки свободных параметров сети (тех же коэффициентов линейных функций).

>>771252

Очевидно же, речь о параметрах линейной функции.

>По какой логике и чему он должен быть равен?

Тебе жи говорят - читай про линейную функцию. В линейной функции ax+b параметр а - это тангенс угла между линейной функцией и положительным направлением координатной оси. Т.е. входное значение х умножается на значение этого тангенса.

А все, кажись понял, для чего оно нужно, для того, чтобы входной сигнал корректировать в согласии с результатом обучения?

Только я еще не понял, сигнал поступает в векторном виде, переводится в скалярный, а потом опять в векторный?

В каких местах идут эти переводы?

И вот этот момент странный

>Для полносвязной сети входной сумматор ней-

рона фактически распадается на два: первый вычисляет линейную функцию от входных сигналов сети, второй – линейную функцию от выходных cигналов других нейронов, полученных на предыдущем шаге.

Такс, Два сумматора

Первый вычисляет результат от входа, второй от других нейронов.

А что дальше с этими результатами происходит?

А все понял, сначала берется вектор, подается в сумматор

У которого есть переменная A

Тот берет и складывает в скалярном виде

Посылает на Нелинейный преобразователь, тот переводит в векторный вид

И все это рассылается?

А от чего сначала зависит параметр A? Чему он равен?

Обучение - это и есть настройка этого параметра A?

Аноны, а объясните, зачем нейрон делает вот это вот?

>Нейрон получает на входе вектор сигналов x, вычисляет его скалярное произведение на вектор весов α и некоторую функцию одного переменного ϕ(x, α).

Я опять ничего не понял, что делает адаптивный сумматор.

Сначала думал, что он берет и находит произведение входящих в него векторов в скалярном виде.

А теперь - это что еще за нахуй? Ну объясните, пожалуйста, я совсем нихуя не понимаю.

Или это может быть любое число вообще?

И я провожу обучающую выборку, показывая взаимосвязь правильную.

А потом я даю сети задачу на нахождение взаимосвязи уже с другими значениями.

Как это все осуществляется, аноны?

Аноны, нейронные сети же работают только с -1,0,1

А как они работают с цифровыми данными?

Ну хотя бы хайкина для ознакомления с темой вообще.

matlab

НЕЙРОНОЧКИ НЕЙРОНОЧКИ НЕЙРОНОЧКИ

НЕЙРОНОЧКИ НЕЙРОНОЧКИ НЕЙРОНОЧКИ

НЕЙРОНОЧКИ НЕЙРОНОЧКИ НЕЙРОНОЧКИ

Хули ты тут забыл?

В связи с этим вопрос: какая математическая подготовка должна быть для нормального восприятия ML, то есть не на уровне "магии"? В ШАД адекватно оценивают сложность темы или всё-таки перестраховываются, дабы оградить менее одарённых товарищей даже от мыслей о поступлении?

Еще лучше будет конкретнее - какие книги по теме стоит переработать перед изучением сабжа?

Ты не поступишь.

> В связи с этим вопрос: какая математическая подготовка должна быть для нормального восприятия ML, то есть не на уровне "магии"?

Хз.

> посмотрел вступительные экзамены для поступления в ШАД, и понял, что там всё достаточно серьезно в плане требований к математике

Нет. Нужно тупо дрочить примерчики из Демидовича. Теорию множеств знать не надо, топологию знать не надо, теорию меры знать не надо. То, что там требуют - это вообще не математика.

А что посоветуете почитать для того, чтобы понять по части матана и всяким приемчикам?

Пожалуйста не на английском и чтобы не много матана было

Волновую модель в топку, а вот распространение всего с помощью паттернов - это фишка.

Представьте, что у вас есть револьвер.

И револьвер - это рекуррентная сеть с открытой памятью.

И при каждой операции у других сетей мы берем и навешиваем им некоторый символ, по которому мы сможем их отличать.

И так вот, если обучить сеть чему-нибудь, закодировать все операции в виде паттернов, дальше, методом векторного квантования мы классифицируем результаты и получаем приоритеты в тех или иных вещах.

Теперь, когда на сеть подаются данные - она ищет соответствия в паттернах, и загружает информацию в слой рекуррентной сети.

Получается, что это работает, как револьвер.

И главное - вычисления можно проводить в несколько потоках, то есть как у человека, который выполняет несколько привычных действий.

Эх, еще бы примотать к этому надклассификацию, чтобы сеть могла выискивать новые значения функции, исходя из старых И в том числе поиск закономерностей

Долбоёб, бля.

Дебилы, бля.

АНОНЧИКИ, ПОСОВЕТУЙТЕ КНИЖКУ ПО ДИП ЛЕАРНИНГУ, ТОЛЬКО НА РУССКОМ БЕЗ МЕТЕМАТИКИ, РЕГИСТРАЦИИ, СМС И КРОСС-ВАЛИДЕЙШЕН. АНОНЧИКИ, А МОЖЕТ ЛИ СЕТОЧКА НАУЧИТЬСЯ ГЛУБОКОМУ БЛОУДЖОБУ? НО ВЕДЬ ЛЮДИ ТАК НЕ ОТЛИЧАЮТСЯ, СЁРЛ, СЁРЛ, СЁРЛ.КАК ПОСТУПИТЬ В ШАД, ЕСЛИ У МЕНЯ ДЕВЯТЬ КЛАССОВ ОБРАЗОВАНИЯ В ШКОЛЕ ДЛЯ ДЕБИЛОВ?

Либо вы очень унылая зелень, умрите[/spoiler[

Правда производить надклассификацию еще очень тяжело.

Но с простыми мат.функциями сеть работает отлично, она быстро научилась всем правилам.

>>772006

>Хочу разобраться в матане без матана

>Без английского.

Что ты тогда тут вообще забыл? Иди английский учи, тебе либо нормальное объяснение на энглише, либо статьи русских маразматиков.

>>772014

Ой, да не агрись ты так, побесится и уйдет

мы же программисты, а не математики.

Да хули там непонятного, блядь

Тебе математическая сумма непонятна?

Или линейная функция?

Или операция умножения двух чисел тебе непонятна, блядь?

Ты не программист - ты говно.

>>772014

Анон, ну объясни хотя-бы как сеть работает с цифровыми данными.

Есть ли где-нибудь пример калькулятора на нейронной сети или вроде того?

Что тебе непонятно?

>для того, чтобы входной сигнал корректировать в согласии с результатом обучения?

Нет. Входной сигнал - это константа, корректировать можно свободные параметры сети.

>значение синаптических весов всегда лежит в диапазоне от 1 до -1

Это значение нелинейной функции активации "нейрона". Параметры линейной функции не обязаны быть от -1 до 1.

Охуеннейший алгоритм, анон, спасибо.

Как нельзя лучше подходит для векторного квантования данных.

Кстати, название на русском "Нейронный газ", блядь.

Интересно, как это визуализировать? Какая-нибудь мозаика Вороного явно подойдет.

То-есть вполне допустимо работать с числами любых размеров?

И я вполне могу обучить нейронную сеть, что 15+5 = 1, она сама подберет синаптические веса, верно?

>я вполне могу обучить нейронную сеть, что 15+5 = 1, она сама подберет синаптические веса, верно?

Да.

Подожди, это растущая сеть.